Como os cientistas estão redefinindo o sucesso

Rankings de universidades, repercussão em periódicos científicos e o número de citações: há quem diga que tais critérios são antiquados para avaliar a qualidade da produção científica, e que são até um obstáculo para o progresso científico. A Suíça quer ajudar a implementar alternativas; uma tarefa que é mais fácil dita do que feita.

De acordo com um relatório recente do Conselho Científico SuíçoLink externo (CCS), atividades científicas diversas como o emprego de pesquisadores, a publicação de artigos, e o investimento público ou privado têm aumentado significativamente nas últimas décadas. Este crescimento causou, por sua vez, um nível de competição sem precedentes por emblemas do sucesso científico como financiamento, prêmios, posições acadêmicas e cargos em periódicos de renome, entre outros.

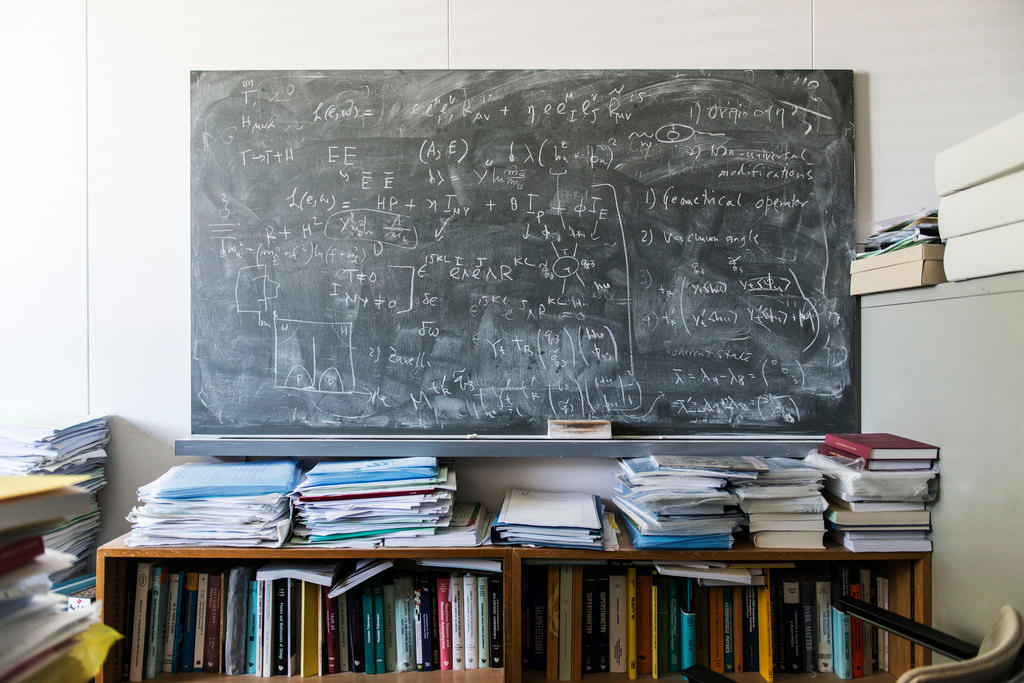

Com a crescente pressão para “publicar ou perecer”, critérios quantitativos de sucesso científico recebem cada vez mais peso (ver quadro), e frequentemente se baseiam nas citações de uma publicação e no fator de impacto de um periódico científicoLink externo, o que pode aumentar ainda mais o incentivo que pesquisadores têm para publicar.

- Índice HLink externo: uma classificação numérica padronizada calculada usando-se o número de artigos científicos publicados por um pesquisador, e o número de vezes em que seus artigos foram citados. Apesar de seu objetivo ser mostrar a produtividade de um cientista e o impacto em seu campo, críticos dizem que o Índice H é demasiado simplista e não pode ser comparado através das distintas áreas da ciência.

- Fator de impacto de periódicoLink externo (FIP): É usado para classificar periódicos por sua importância em suas respectivas áreas. O FIP é calculado com base no número médio de vezes que os artigos publicados por um periódico foram citados nos últimos dois anos. O FIP é um método simples de comparação, mas tem suas deficiências: ele não avalia a qualidade do artigo, nem sempre pode comparar através de diferentes áreas, e pode ser enviesado por artigos que embora sejam poucos, são muito citados.

- Rankings de universidadesLink externo: A classificação pode ser feita com base na transferência de conhecimentos e citações, bem como no desempenho dos professores. Como mais universidades têm lutado por acesso a recursos, cientistas e estudantes, rankings globais se tornaram um instrumento cada vez mais útil para avaliar a qualidade e o impacto destas organizações. No entanto, segundo relatório da UNESCOLink externo, estes rankings criam incentivos para que as instituições se concentrem excessivamente em pesquisa de alto impacto para melhorar sua colocação, em detrimento de suas responsabilidades educacionais e sociais.

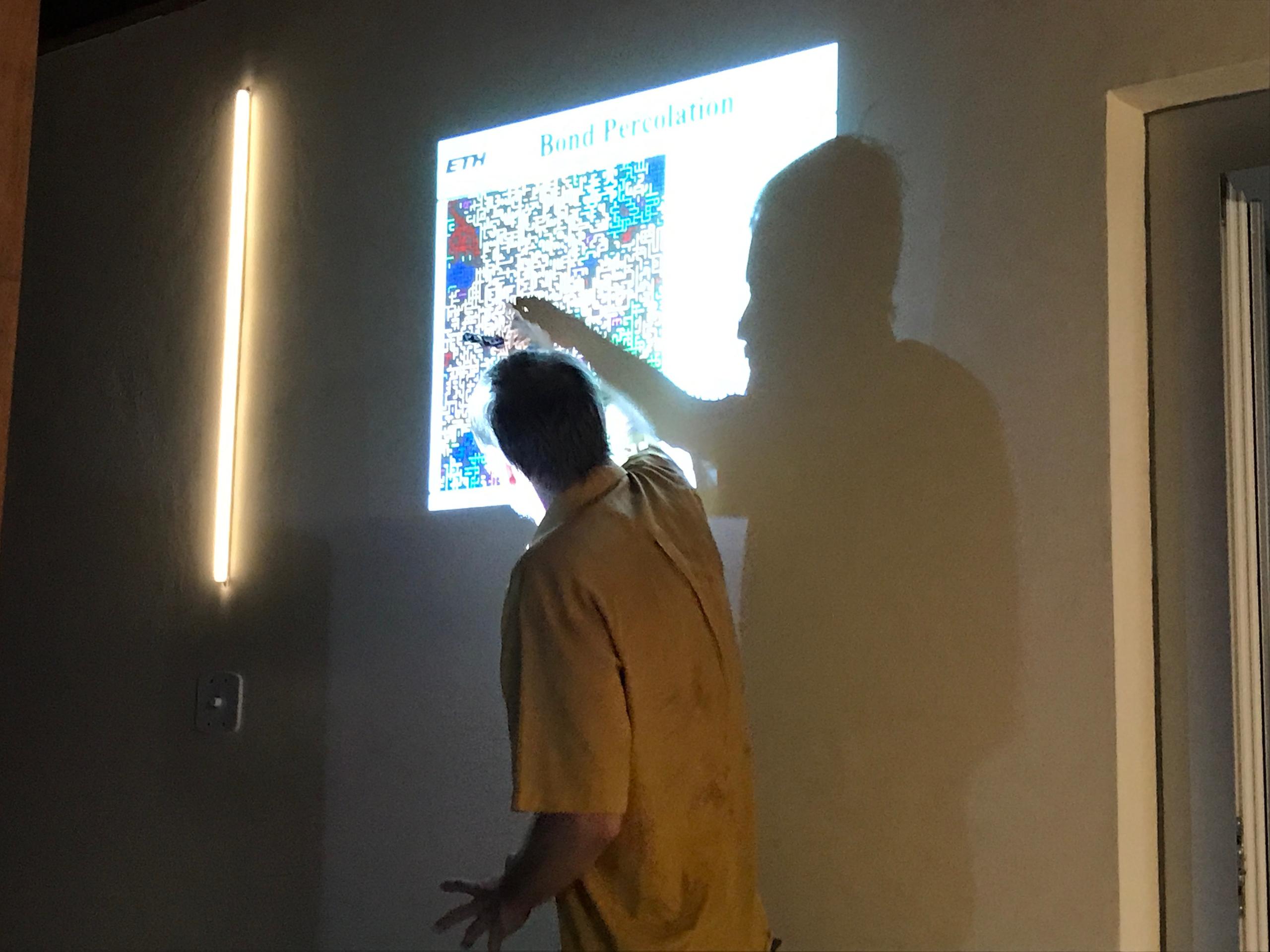

Trata-se de um “paradoxo” da ciência moderna, afirmou o presidente das Academias Suíças de Artes e Ciências, Antonio Loprieno, em uma recente conferência em BernaLink externo.

“Por um lado, o uso de medidas contemporâneas de desempenho científico aumentou exponencialmente juntamente com o aumento de recursos, o que para nós é algo muito bom. Por outro lado, temos reservas quanto à sua justiça, validade e aplicabilidade”, disse Loprieno.

Para responder a essas críticas, o CCS publicou recomendaçõesLink externo para a comunidade científica suíça com vistas a mudar a forma pela qual o Conselho avalia e financia pesquisa, notadamente através da utilização de indicadores qualitativos como complemento (e não substituto) aos indicadores quantitativos.

“Nos últimos anos, indicadores [quantitativos] têm sido progressivamente usados como substituto para a avaliação qualitativa; uma prática que tem dado incentivos errados aos pesquisadores e ameaçado a qualidade científica”, afirma o relatório.

“Uma estratégia nacional que leve em conta a diversidade de disciplinas e requisitos institucionais para uma avaliação diferenciada deveria ser promovida”.

Mais do que apenas um número

A ênfase excessiva em critérios quantitativos, dizem os críticos, leva à deterioração do próprio rigor científico que essas medidas deveriam supostamente promover; sem mencionar o tremendo estresse que implica para os próprios cientistas.

“Segundo o Google, meu Índice HLink externo é 48, o que significa que eu tenho 48 artigos que têm pelo menos 48 citações. Eu não gosto de ser reduzido a um mero número, mas existem pessoas nesse planeta que pensam sobre mim em termos de um mero número”, disse Stephen Curry, um dos palestrantes na conferência de Berna e professor de biologia estrutural no Imperial College de Londres.

“Você pode usar números para caracterizar alguns aspectos, mas a ciência é fundamentalmente uma atividade humana. Não se pode simplesmente medir a excelência na ciência; isso deve ser uma questão de juízo, discussão e opinião de especialistas”.

Curry chefia o comitê executivo da Declaração de São Francisco sobre Avaliação de Pesquisa (DORALink externo); um dos muitos esforços recentes de repensar como a própria ciência é avaliada e de identificar novas diretrizes para avaliar pesquisadores e instituições de forma mais holística, mas ainda com eficiência suficiente para manter o avanço da ciência.

Quantificando a qualidade

Críticos também argumentam que indicadores quantitativos com o índice H são propensos a distorções pela falta de transparência quanto a seu calculo e aplicação. Para eles, esses critérios quantitativos desencorajam pesquisa diversa de alto risco e grandes retornos em favor do conformismo e da uniformidade.

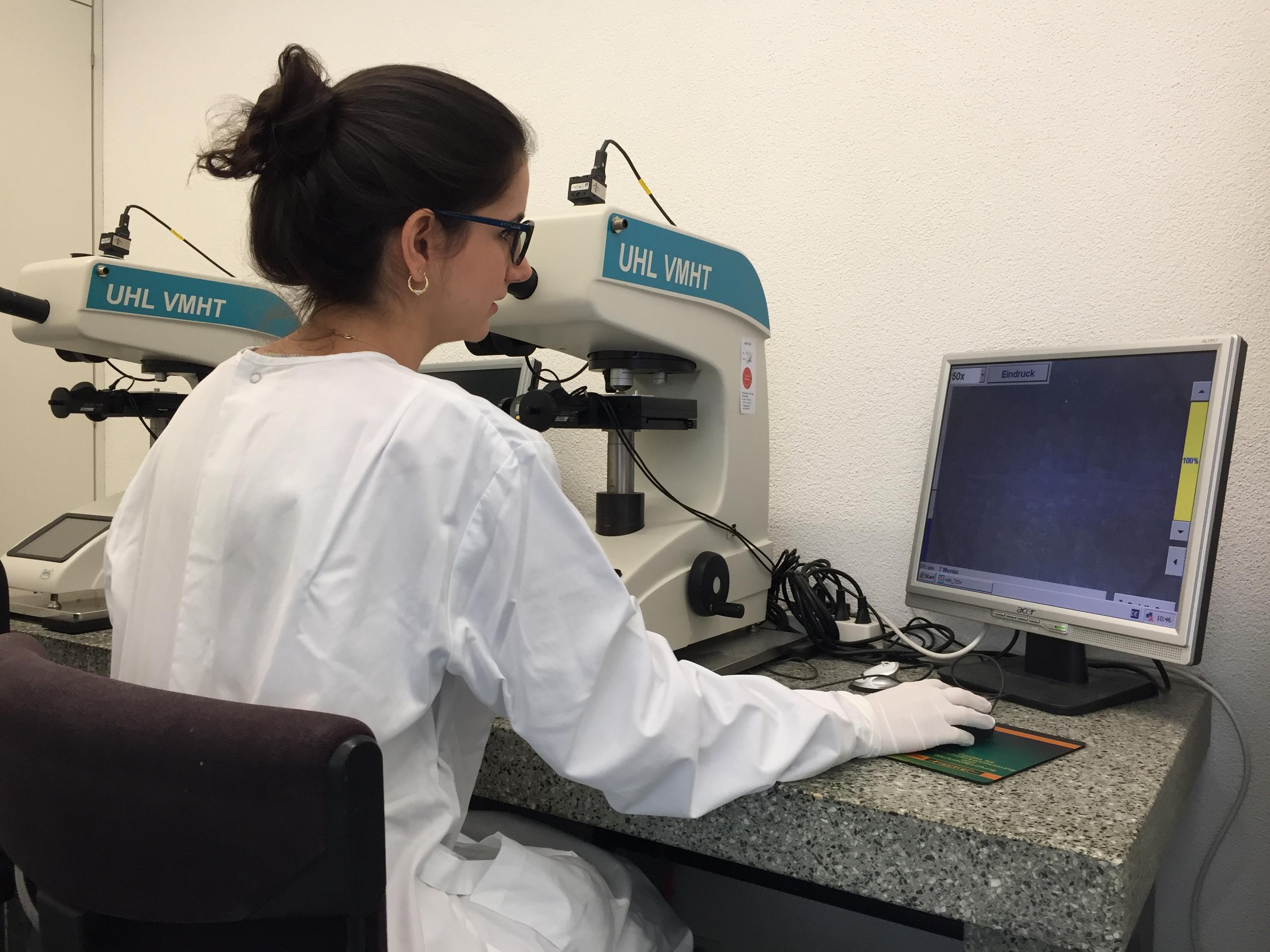

Para Ellen Hazelkorn, diretora da Unidade de Pesquisa sobre Política de Educação no Instituto de Tecnologia de Dublin, esses critérios quantitativos são particularmente problemáticos em uma época onde a ciência é para todos, e não apenas para os poucos membros de uma elite em suas torres de marfim.

“No momento em que a pesquisa é vista como tendo valor e impacto além da academia, ela deixa de ser a busca da curiosidade intelectual de um indivíduo, mas sim [deve ser] equilibrada por prioridades sociais e nacionais”, disse Hazelkorn.

Ela acrescentou que critérios de classificação como rankings institucionais – por exemplo, o Higher Education World University RankingsLink externo que é recebido com muita expectativa anualmente pelo público – são “largamente inadequados para uma sociedade altamente participativa” porque eles tratam da responsabilidade apenas dentro da esfera acadêmica, e não na sociedade como um todo.

“Rankings são de fácil compreensão, mas seus indicadores de sucesso aumentam os níveis de desigualdade e estratificação em nossas sociedades, o que por sua vez tem implicações para os bens públicos”.

Simplicidade também constitui grande parte do apelo de critérios de avaliação individual ou de periódicos tais como a contagem de citações e o fator de impacto de periódicos, diz Curry. “Critérios quantitativos são fáceis de serem calculados; eles têm uma pseudo-objetividade sedutora, e facilitam nossas vidas”.

Pressão e prestígio

Mas a que custo? Como Curry explicou, concentrar-se demasiado nesses instrumentos pode até desacelerar o progresso científico ao encorajar que pesquisadores submetam seu trabalho aos periódicos de maior prestígio possível, o que aumenta a possibilidade de rejeição ou até mesmo de retratação do artigo, o que também pode minar a confiança do público na ciência.

Ademais, ao restringir o interesse acadêmico a publicações de prestígio, outras atividades importantes como ensino, comunicação, extensão e treinamento de jovens cientistas são subestimadas, podendo ser até prejudicadas.

Hoje, DORA foi assinado por aproximadamente 14.000 indivíduos e organizações. O Manifesto de LeidenLink externo de 2015 também ganhou influência na comunidade acadêmica. Ambos os documentos exortam à redução da utilização de critérios quantitativos, ou pelo menos sua utilização em conjunto com outros critérios qualitativos centrados no conteúdo científico.

Alternativas emergentes

A ciência ainda está crescendo rapidamente, e todos querem ser excelentes. Mas em se tratando da realidade da prática científica, como métodos de avaliação mais holísticos, e possivelmente mais demorados, podem resistir à tentação de se utilizar critérios “rápidos e rasteiros”?

Para Sarah de Rijcke, vice-diretora do Centro de Estudos de Ciência e Tecnologia (CWTS) da Universidade de Leiden, na Holanda – o berço do Manifesto de Leiden -, uma resposta está no que ela chama de “abordagem de portfólio” para avaliar ciência; uma abordagem que poderia ser adaptada a uma dada situação, instituição ou investigador.

“Soluções universais não são muito efetivas”, disse de Rijcke, porque os tipos de pesquisa mais favorecidas pelos métodos tradicionais de avaliação variam entre disciplinas. Ao contrário, para um dado contexto de avaliação, ela recomenda princípios genéricos para se criar uma “narrativa padronizada” que una a especialização do cientista, sua produção (publicações, dotações acadêmicas, ensino e até mídia social) e influência na ciência e sociedade.

O comitê DORA também lista exemplos de tais abordagens em seu website; por exemplo, ao pedir que pesquisadores sumarizem suas melhores publicações e contribuições em suas próprias palavras no formato de um “sumário biográficoLink externo” (biosketch).

Stephen Curry observou que a tendência da comunidade científica global (também observada na SuíçaLink externo) em direção ao acesso livre também deverá acelerar mudanças nos critérios de avaliação, já que periódicos de acesso livre e arquivos digitais pré-publicaçãoLink externo (pre-print archives) podem encorajar uma maior ênfase no conteúdo e na transparência em comparação a periódicos tradicionais por assinatura.

Responsabilidade suíça

Loprieno disse para swissinfo.ch que a Suíça tem uma obrigação internacional de levar adiante a mudança, dada a abastança de seus recursos e flexibilidade nos requisitos administrativos quando comparada a outros países europeus.

“Eu penso que como temos um sistema tão bem financiado, nós também temos certa responsabilidade com o resto do mundo. A Suíça pode experimentar ou tentar soluções de forma mais ativa para ver como superar as dificuldades do sistema atual”, disse ele.

Um dos maiores desafios, ele acrescentou, será assegurar que jovens cientistas no início de suas carreiras tenham apoio adequado durante a transição para critérios de avaliação mais diversos.

“Minha solução seria termos um pouco mais de tolerância para projetos de longo prazo. Temos a tendência de apoiar e financiar no curto prazo, o que tem a ver com esta lógica competitiva. Se financiássemos com uma perspectiva de longo prazo, isso reduziria a pressão nos estágios iniciais da carreira [acadêmica] e criaria um sistema mais igualitário”.

Lopriano reconhece que uma mudança dessa magnitude na cultura da pesquisa é mais fácil dita do que feita, o que não significa dizer que seja impossível.

“Esta é também uma cultura que queremos rever. Precisamos então começar de alguma maneira, em algum lugar”, disse ele.

Adaptação: D.v.Sperling

Certificação JTI para a SWI swissinfo.ch

Mostrar mais: Certificação JTI para a SWI swissinfo.ch

Veja aqui uma visão geral dos debates em curso com os nossos jornalistas. Junte-se a nós!

Se quiser iniciar uma conversa sobre um tema abordado neste artigo ou se quiser comunicar erros factuais, envie-nos um e-mail para portuguese@swissinfo.ch.