كيف يحاول العلماء السويسريون رصد الوسائط المفبركة باستخدام تقنية “ديبفيك”؟

مع تطور مقاطع الفيديوهات المزيفة باستخدام الذكاء الاصطناعي بشكل متزايد، يعمل الخبراء في سويسرا، على إعادة تقييم مخاطر استخداماتها المغرضة على المجتمع - وإيجاد طرق مبتكرة لإحباط مخططات المتورطين فيها.

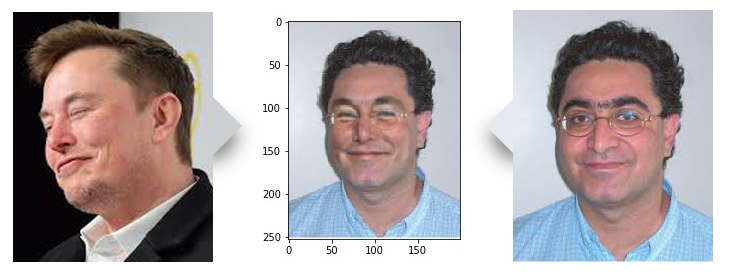

في مختبر الكمبيوتر التابع للحرَم الشاسع للمعهد التقني الفدرالي العالي بلوزان، يتأمل فريق صغير من المهندسين في صورة رجل مبتسم، وردي البشرة، شعره أسود مجعّد، ويرتدي نظارة.

“نعم، هذا واحد من الأعمال الجيّدة”، كما يقول الباحث البارز توراج إبراهيمي، الذي يحمل تشابهاً عابراً مع مؤسس تسلا إيلون موسك، الظاهرة صورته على الشاشة. قام الفريق بطريقة حرَفية بالتلاعب بصورة رأس إبراهيمي وإسقاطه على صورة على الإنترنت لهذا الرجل، لابتكار صورة رقمية ومقاطع فيديو مفبركة من خلال الذكاء الاصطناعي.

إنها واحدة من الأمثلة المزيفة – وبعضها ما هو أكثر واقعية من غيرها من الصور- والتي قام فريق إبراهيمي بالتعاون مع شركة الأمن الإلكتروني “كوانتوم إنتغريتي” رابط خارجيQuantum Integrity (QI)رابط خارجي بفبركتها أثناء تطوير برنامج يمكنه اكتشاف الصور التي تم التلاعب بها، بما فيها تلك التي تم تلفيقها باستخدام تقنية “ديبفيك”.

ويعمل البرنامج على معرفة الفوارق بين الأصلي والمزور باستخدام تقنية التعلم الآلي، وهي نفس التقنية الكامنة وراء إنشاء “المقاطع بالغة الزيف” أو “ديبفيك”: فهناك “مبتكر” يغذي البرنامج بصور مزيفة، ويحاول “كاشف” العثور عليها بعد ذلك.

“مع الكثير من الإعداد والتدريب، يمكن للآلات أن تساعد في اكتشاف عمليات التزوير بالطريقة نفسها التي قد يلجأ إليها الإنسان”، كما يوضح إبراهيمي. ويضيف قائلاً: “كلما زاد استخدام هذه الآلات، كلما جاءت النتائج أفضل.”

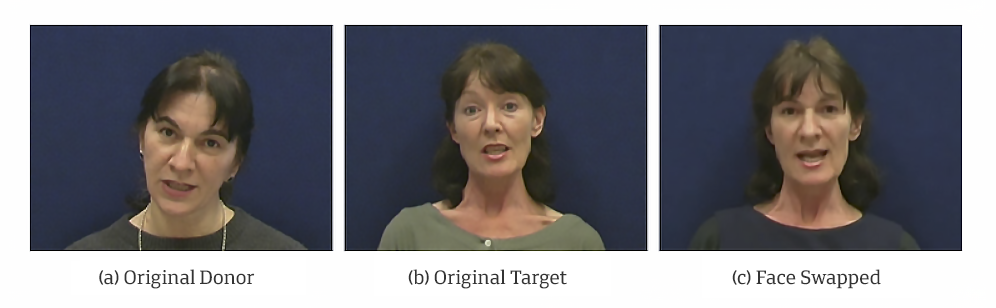

والجدير بالذكر، أن الصور ومقاطع الفيديو المزيفة موجودة منذ ظهور الوسائط المتعددة، لكن تقنيات الذكاء الاصطناعي الحديثة، لم تسمح للمزيفين سوى بتغيير الوجوه في مقطع فيديو، أو جعل شخص يبدو وكأنه يقول شيئاً، لم يقله مطلقاً. وخلال السنوات القليلة الماضية، فاقت سرعة انتشار تقنية “ديبفيك”، توقع معظم الخبراء.

وفقاً لمجلس الحوكمة الدولية للمخاطررابط خارجي في المعهد التقني الفدرالي العالي بلوزان، فقد أصبح تصنيع مقاطع فيديو، بتقنية “ديبفيك” و”بشكل تصاعدي، أسرع وأسهل وأرخص”، وذلك بفضل توزيع أدوات برمجية سهلة الاستخدام، وتقديم خدمات وتطبيقات ذات صلة، مدفوعة عبر الإنترنت.

“ولأن تطوّرها يجري بسرعة كبيرة تحديدا، بتنا نحتاج إلى معرفة حدود هذا التطور – وما هي القطاعات والمجموعات والبلدان التي قد تتأثر به” بحسب قول نائب مدير المركز، أنجوس كولينز.

وعلى الرغم من أن الكثير من مشاكل تقنية “ديبفيك” الخبيثة، تتعلق باستخدامها في إنتاج المواد الإباحية، فإن هناك حاجة متزايدة إلى الاستعداد لكشف الحالات التي يتم فيها استخدام هذه التقنيات، من أجل التلاعب بالرأي العام.

مجال يتطوّر بسرعة

عندما بدأ الإبراهيمي، منذ ثلاث سنوات، العمل مع “كوانتوم إنتغريتي”رابط خارجي Quantum Integrity لأول مرة على برنامج الكشف، لم تكن قضايا المقاطع المزيفة بعمق، على جدول أعمال معظم الباحثين. في ذلك الوقت، كان عملاء قلقين بشأن الصور التي تم تزييفها والتلاعب بها، والمستخدمة عند الحوادث، في مطالبات تعويضات التأمين على السيارات وعلى المنازل. ولكن، بحلول عام 2019، عندما وصلت التقنية المستخدمة إلى مستوى متقدّم من التطور، تم اتخاذ القرار بتكريس المزيد من الوقت لهذه القضية.

يقول أنتوني ساحاكيان، الرئيس التنفيذي لشركة “كوانتوم إنتغريتي”: “أنا مندهش، لأنني لم أعتقد أنها [التقنية] ستتطوّر بهذه السرعة الكبيرة”.

لقد رأى ساحاكيان بشكل مباشر إلى أي مدى حققت تقنيات “ديبفيك” نتائج بدت واقعية، وكان آخرها تبديل صوَر الوجوه على جواز سفر، بطريقة تركت جميع أختام المستندات سليمة.

والواقع، أن التحسينات في تقنيات التلاعب بالصور والفيديوهات ليست وحدها موضع اهتمام الخبراء من أمثاله، بل أعدادها المتزايدة؛ حيث وصل عدد مقاطع الفيديو المزيّفة بعمق على الإنترنت إلى الضعف تقريباً، وذلك خلال فترة تسعة أشهر، فبلغت 14678 بحلول سبتمبر 2019، وفقاً لتقديرات شركة أمن الإنترنت الهولندية “ديب تريس” Deeptrace.رابط خارجي

مواطن الخطر

تستهدف معظم عمليات التزييف العميقة التي تم القيام بها على الإنترنت بغرض الإيذاء، النساء اللواتي تم نقل وجوههن إلى أخريات يظهرن في لقطات أو صور إباحية. ووفقاً لتقديرات شركة أمن الإنترنت الهولندية “ديب تريس” Deeptrace، فإن هذا النوع من الاستخدام استحوذ في عام 2019، على 96 % من مقاطع الفيديو التي استخدمت فيها تقنية “ديبفيك” والموضوعة على الإنترنت. ويظهر البعض من هذه الفيديوهات أو الصور، على مواقع إباحية مخصصة بإنتاج المقاطع بالغة الزيف، بينما ينضوي نشر البعض الآخر منها، تحت ما يسمّى بـ ” الانتقام الإباحي” الذي يهدف إلى الإساءة إلى سمعة الضحايا.

يقول كولينز: “الابتزاز والتنمّر عبر شبكة الإنترنت هي من المواضيع المتكررة”. في المقابل، تعد الحالات التي استخدمت فيها تقنية “ديبفيك”، من أجل ارتكاب عمليات احتيال، وتمّ التفطّن إليها، قليلة. وقد اتخذت معظم هذه الحالات شكل انتحال صوتي لشخص يعرفه الضحايا، لتحويل أموالهم إلى المزور.

من ناحية أخرى، ما يزال قطاع الأعمال في مرحلة تدوين الملاحظات لأخذ كل هذه الأخطار بعين الاعتبار. وقد أرسلت بعض الشركات ومن يبنها شركة زيورخ للتأمين و شركة “سويس ري Swiss Re ” للتأمين وإعادة التأمين ومصرف “بي إن بي باري با BNP Paribas “، ممثلين لها إلى ورشة عمل نظمها مجلس الحوكمة الدولية للمخاطر حول مخاطر تقنية “ديبفيك”.

ويقول ساحاكيان إن الاستخدام المحتمل لمقاطع فيديوهات مفبركة باستخدام هذه التقنية في مطالبات تعويضات الحوادث، على سبيل المثال، هو مصدر قلق في أوساط شركات التأمين، التي يعمل معها.

ويضيف: “إن التكنولوجيا الآن موجودة لجعل عملية KYC [أعرف عميلك] بائدة وعديمة الجدوى”، في إشارة منه، إلى عملية التحقق من هوية العملاء ونواياهم، التي تتبعها المؤسسات التجارية، من أجل تجنب إمكانية وقوعها ضحية الاحتيال.

المزيد

هكذا يقوم برنامج سويسري بتدريس الخصوصيّة على الإنترنت للأطفال..

كما أدى تنامي انتشار تقنية “ديبفيك” أيضاً إلى بروز مخاوف حول إمكانية استخدامها للتدخل في العمليات السياسية.

وقد تأكدت هذه المخاوف عندما ظهر شريط فيديو تم التلاعب به، تبدو فيه نانسي بيلوسي رئيسة مجلس النواب الأمريكي، لتشويه خطابها. كانت التكنولوجيا المستخدمة في التلاعب بالفيديو ذات نوعية منخفضة، أو ما يسمى بـ”التزييف الرخيص”. ولكن كما يقول إبراهيمي، “إنها علامة على ما يمكن القيام به، والنوايا التي تكمن وراء هذا النوع من التلاعب بالإعلام.”

التكيف مع واقع رقمي جديد

ومع ذلك، يحذر خبير المخاطر كولينز من أن استخدام وسائل الإعلام الاصطناعية في السياسة يجب أن يوضع في سياقه. ويحذر قائلاً: “من المحتمل أن تلعب تقنية “الديبفيك” دوراً في زعزعة نتائج الانتخابات، لكنني أتوخّى الحذر من التشديد المفرط على خطر هذه التقنية، لأنك بذلك تُخاطر بتجاهل الصورة الكاملة”.

ويقول إن ما تفعله “الديبفيك” هو “الفجوة المحتملة الناشئة بين سرعة تطور النظام الإيكولوجي للمعلومات الرقمية وقدرة المجتمع على التكيّف معه”.

ولإعطاء مثال على هذا، يعود كولينز إلى استخدام تقنية “الديبفيك” كأداة للتنمّر الإلكتروني؛ فيقول: “هذا الأمر يثير أسئلة حول مدى استجابة النظم القانونية للأذى الفردي عبر الإنترنت”. ويضيف: “كيف يمكنك التخلّص من المحتوى الرقمي المسيء بعد مجرد ابتكاره، وكيف تجد مبتكره الأصلي أو تتخذ بحقه أية إجراءات قانونية، خاصة إذا كان يخضع لسلطة قضائية أخرى؟”.

يمكن أن تساعد تقنية “الديبفيك” أيضاً في حملات التضليل، مما يؤدي إلى تآكل حلقة الوصل بين الحقيقة والثقة بها.

الذكاء الاصطناعي لتزييف المقاطع ولكشف التزييف

قد يسبب استخدام هذه التقنية حالة من الذعر في بعض الأوساط، لكنه لا يوجد إجماع على أن مقاطع الفيديو المفبركة واقعية لدرجة أن تخدع معظم المستخدمين. يقول الخبراء إن جودة هذه التقنية اليوم لا تزال تعتمد إلى حد كبير على مهارات المبتكر. ويوضح خبير أمن المقاييس الحيوية سيباستيان مارسيل، أن تبديل الوجوه على فيديو ما، يسبب حتماً وجود بعض العيوب في الصورة.

ويقول: “ستكون الجودة متباينة بدرجة كبيرة، بحسب العمل اليدوي الذي تم القيام به لتعزيز الصورة. فإذا بذل المبتكر جهداً لمواءمة النتيجة مع النسخة الأصلية، فقد يكون من الصعب جداً اكتشاف التزييف”.

يعمل مارسيل وزملاؤه في معهد أبحاث “أي دياب Idiap ” في مارتيني – جنوب غرب سويسرا، على برنامج للكشف خاص بهم، في مشروع كان نتيجة الجهود المبذولة للكشف عن التلاعب في الوجوه والأصوات في لقطات الفيديو.

ويقوم معهد “Idiap ” بالعمل في هذا المجال على المدى الطويل. يقول مارسيل: “لن يتم حل هذه المشكلة في الحال”. “إنه موضوع بحث متنامي ولذا فإننا نخطط لكيفية رصد المزيد من الموارد في هذا المجال.”

ويشارك هذا المعهد غير الهادف للربح، في تحدٍ أطلقه موقع فيسبوك لإنتاج برنامج اكتشاف للصور والفيديوهات المزيفة بتقنية “الديبفيك”، من أجل مساعدة هذا الأخير على الاستفادة من بعض النتائج الأولية التي حصل عليها. وتعهد عملاق وسائل التواصل الاجتماعي بالمساهمة، بأكثر من 10 ملايين دولار للباحثين في مجال الكشف عن الحقائق المزيّفة، في جميع أنحاء العالم (انظر الحاشية).

ولكن ما قد يحدثه الكشف عن الفارق بين الحقيقة المجردة والحقيقة المزيّفة، هو موضوع مطروح للنقاش.

يقول كولينز: “من غير المحتمل إيجاد حل سحري؛ فمهما امتلكنا من تقنيات لكشف التزوير، فإن الخصم سوف يجد طريقة للتغلب عليها.”

لعبة القط والفأر

يقول كل من إبراهيمي ومارسيل إن هدفهما ليس التوصل إلى أداة تشكل مفتاح أمان؛ فجزء من وظيفة الكاشف هو توقع المنحى الذي قد يسلكه المتلاعبون بالحقائق، وضبط أساليبهم وفقاً لذلك.

ويتوقع مارسيل من معهد “Idiap” مستقبلاً يتمكن فيه مبتكري المقاطع بالغة الزيف، ليس فقط من تغيير جانب واحد من الفيديو، مثل الوجوه، وإنما الصورة بأكملها.

ويقول: ” إن جودة تقنيات “الديبفيك” آخذة في التحسن، لذا يتعين علينا مواكبة الأمر بتحسين أجهزة الكشف كذلك”، حتى لا تعود نسبة التكلفة إلى العائد، والناتجة عن صنع مقاطع خبيثة بالغة الزيف، في صالح المبتكر.

يعتقد إبراهيمي من المعهد التقني الفدرالي العالي بلوزان أن حدثاً كبيراً، مثل الانتخابات الرئاسية في الولايات المتحدة، يمكن أن يمنح الجهات الفاعلة الخبيثة حافزاً لتسريع عملها في هذا المضمار، مع وضع هدف واضح في الاعتبار.

“قد يستغرق الأمر شهوراً أو أعواماً” قبل أن تصبح العين المدربة قادرة على اكتشاف ما هو زائف، وفي هذه المرحلة، ستكون الأجهزة هي فقط، من تملك القدرة على القيام بذلك.

أدخل تويتر Twitter قاعدة جديدة في مارس 2020 ضد مشاركة محتوى الوسائط الاصطناعية أو التلاعب الذي يمكن أن يسبب بأذية الآخرين. من بين الإجراءات التي ستتخذها، هي وسم هذه التغريدات وتحذير المستخدمين منها. كما تعهدت شركة يوتيوب YouTube، المملوكة لشركة غوغل Google، بأنها لن تتسامح مع مقاطع الفيديو البالغة الزيف ذات الصلة بالانتخابات أو بالإحصاءات في الولايات المتحدة عام 2020، والتي تم تصميمهما لتضليل الجمهور. وقد أطلق فيسبوك Facebook تحدياً بقيمة تزيد عن 10 ملايين دولار لدعم الباحثين في مجال الكشف عن الحقائق المزيّفة حول العالم. كما أصدر كل من فيسبوك Facebook وغوغل Google مجموعات بيانات لمقاطع بالغة الزيف، لمساعدة الباحثين على تطوير تقنيات الكشف.

بحسب مجلس الحوكمة الدولية للمخاطر (IRGC):رابط خارجي “فإن المصنفات الأكثر تداولاً على نطاق واسع تميل إلى السخرية، حيث تتضمن شخصيات بارزة” مثل المشاهير والسياسيين، مما يشير إلى أنه “لا يتم ابتكار كل المقاطع بقصد خبيث”. وقد انخرطت هوليوود أيضاً في تقنية “الديبفيك”، للسماح على سبيل المثال، بعودة الممثلين المتوفين منذ وقت طويل إلى الشاشة الفضية. ويقول إبراهيمي من EPFL إنه إذا سار كل شيء وفقاً للخطة الموضوعة، فقد تكون النتيجة الثانوية لمشروع EPFL / QI لتطوير برنامج الكشف عن المقاطع بالغة الزيف هو الاستخدام النهائي لنفس التكنولوجيا لإنشاء مؤثرات خاصة للأفلام.

وتشمل الاستخدامات الإيجابية المحتملة الأخرى لتقنيات “الديبفيك” التوليف الصوتي للأغراض الطبية والطب الشرعي الرقمي في التحقيقات الجنائية، وفقاً لمجلس الحوكمة الدولية للمخاطر.

متوافق مع معايير الصحافة الموثوقة

المزيد: SWI swissinfo.ch تحصل على الاعتماد من طرف "مبادرة الثقة في الصحافة"

يمكنك العثور على نظرة عامة على المناقشات الجارية مع صحفيينا هنا . ارجو أن تنضم الينا!

إذا كنت ترغب في بدء محادثة حول موضوع أثير في هذه المقالة أو تريد الإبلاغ عن أخطاء واقعية ، راسلنا عبر البريد الإلكتروني على arabic@swissinfo.ch.