L’etica nelle nuove tecnologie: una meravigliosa teoria di difficile applicazione

L’etica è diventata una parola alla moda. Nel mondo ipertecnologico di oggi, si sta posizionando sempre di più come la conditio sine qua non per la progettazione di robot e sistemi intelligenti. Tutto questo solo in teoria. Nella pratica, passare dall’”etica di facciata” all’etica di sostanza è sempre più difficile.

Secondo uno studio del Massachusetts Institute of Technology (MIT)Collegamento esterno, esiste un gap sostanziale tra come l’intelligenza artificiale (IA) può essere usata e come dovrebbe essere usata. Lo studio mette in luce che ben il 30% delle grandi aziende statunitensi sta attivamente implementando l’IA. Non molte però hanno un piano concreto per garantire la correttezza etica delle loro soluzioni.

Questa statistica ci riguarda da vicino. La maggior parte dei giganti della tecnologia mondiali sono concentrati sulla costa pacifica degli Stati Uniti, tra la Silicon Valley (pensiamo a Google, Facebook, Apple, Microsoft) e Seattle (Amazon). Sono i cosiddetti GAFAM, i magici 5 “moschettieri” della rivoluzione tecnologica, che influenzano sempre di più la nostra vita fuori e dentro il web.

“L’intelligenza artificiale è ovunque e sta avanzando velocemente; tuttavia, molto spesso gli sviluppatori di strumenti e modelli di IA non sono veramente consapevoli di come questi si comporteranno quando saranno impiegati in complessi contesti del mondo reale”, mi ha detto in un’intervista Alexandros Kalousis, professore di Data Mining e Machine Learning presso l’Università di Scienze Applicate della Svizzera occidentale. “La realizzazione delle conseguenze dannose arriva solo a posteriori, se mai arriva”, ha aggiunto il professore.

L’IA è uno strumento potente con implicazioni di vasta portata sul mondo reale, sulla società e sugli individui. Siamo già tutti soggetti a raccomandazioni e profilazioni basate sui nostri comportamenti su Internet. L’ubiquità dell’IA è ormai assodata. “Il modo in cui i sistemi di IA cambiano il nostro futuro dipende dalle persone e dalle politiche che guidano le loro implementazioni”, dice la ricercatrice di IA etica Aparna Ashok in un portrait sul suo lavoroCollegamento esterno.

Per prevedere e mitigare i rischi delle nuove tecnologie, servirebbero però anche ricerche imparziali e svincolate dagli interessi del business. Ma spesso, la ricerca è finanziata proprio dalle grandi aziende, che promuovono l’importanza dei principi morali facendo allo stesso tempo l’occhiolino ai propri interessi commerciali.

Il caso di Timnit GebruCollegamento esterno, l’illustre ricercatrice di etica dell’IA licenziata in tronco da Google dopo la pubblicazione di un articolo che criticava il cuore del business dell’azienda – il suo motore di ricerca – ne è un esempio.

In un articolo di imminente pubblicazione, swissinfo.ch analizzerà il caso di Gebru e la cosiddetta pratica dell’”ethics washing”, e cioè l’etica di facciata, con esperti e Googlers dalla Svizzera.

Vi fa paura il potere dei giganti della tecnologia? Come affrontate queste questioni nella vostra vita quotidiana? Parliamone! Scrivetemi i vostri commenti.

Etica e robotica: quali valori?

Per questa edizione della newsletter, la nostra collaborazione con l’NCCR – il Centro nazionale di competenza nella ricerca roboticaCollegamento esterno – ci ha portato a esplorare la questione dell’etica anche nel mondo della robotica.

Abbiamo parlato con Aude BillardCollegamento esterno, professoressa di Machine Learning e Robotica presso il Politecnico federale di Losanna (EPFL):

SWI swissinfo.ch: Professoressa, quali sono i rischi e i benefici dell’uso dei robot su larga scala?

Aude Billard: è una domanda molto audace. Tutto dipende da ciò che si intende per benefici e rischi. Per quanto riguarda le applicazioni in campo medico, come le protesi e le sedie a rotelle, vedo soprattutto i vantaggi. Questi dispositivi permettono alle persone di tornare a una vita normale. Ma anche una sedia a rotelle robotizzata può presentare dei problemi, come analizzare l’ambiente circostante utilizzando dati personali.

Per quanto riguarda l’uso dei robot in ambito miliare, invece, personalmente vedo solo dei rischi. Si potrebbe pensare che l’utilizzo di robot negli eserciti riduca il numero di persone uccise. Ma in realtà una macchina potrebbe uccidere con più frequenza e in maniera più precisa.

C’è poi la questione della sicurezza: se utilizzassimo dei droni per la consegna dei beni a domicilio, avremmo meno traffico sulle strade ma il rischio che il robot urti un umano e qualcuno si faccia male esiste. La domanda sia etica che politica è: come possiamo trovare un compromesso tra la sicurezza e il confort nella nostra società? Credo che sia necessario discutere di più su come bilanciare questi due differenti valori.

Pensa che l’”ethics washing” sia un tema anche nella robotica?

Nell’ambito della robotica esistono delle linee guida. Attraverso il progetto chiamato “P7000”Collegamento esterno, l’IEEE [La più grande organizzazione professionale tecnica del mondo dedicata al progresso della tecnologia a beneficio dell’umanità] sta cercando di creare uno standard per certificare l’etica dei dispositivi robotici già in fase di design. E se questo è positivo da una parte, dall’altra la preoccupazione riguarda il fatto che i robot navigano già il nostro mondo e avremmo avuto bisogno ormai da tempo di uno standard etico, che prenda in considerazione anche l’impatto dei robot sull’ambiente umano. Ma non credo che saranno prodotte delle linee guida in questo senso a breve termine.

Quali questioni etiche dovrebbe essere affrontate con più urgenza nel campo della robotica?

È molto importante che la società si metta d’accordo per definire i propri valori etici. Al momento ci sono tante contraddizioni, basta guardare il settore militare: tutti sono d’accordo che non è etico uccidere ma gli Stati addestrano i soldati a uccidere e supportano azioni belliche.

Nella robotica, la questione è la stessa: bisogna trovare un accordo a livello europeo su quali siano i valori di riferimento più importanti. Anche qui ci sono delle contraddizioni: non vogliamo che i robot arrechino dei danni ma li utilizziamo pur sapendo che potranno nuocere a qualcuno (mi riferisco, per esempio, ai veicoli autonomi). Ma come si può attribuire la responsabilità dei danni causati da un robot? Ecco perché ci vuole un equilibrio tra ciò che non è accettabile eticamente e i rischi che siamo pronti a correre come società.

Secondo lei è “etico” aspettarsi la perfezione dai robot?

Non so se sia etico o meno. Sicuramente non è realistico. Più il sistema è complesso più le possibilità che qualcosa non funzioni come dovrebbe aumentano e diventa più difficile identificare il problema. Per questo sono necessarie linee guida molto precise per la progettazione effettiva, per esempio, di veicoli e sedie a rotelle autonomi.

Avete un’opinione in merito? Parliamone di fronte a un caffè (virtuale).

Prossimi eventi da non perdere

Interazioni a prova di contatto grazie all’IA

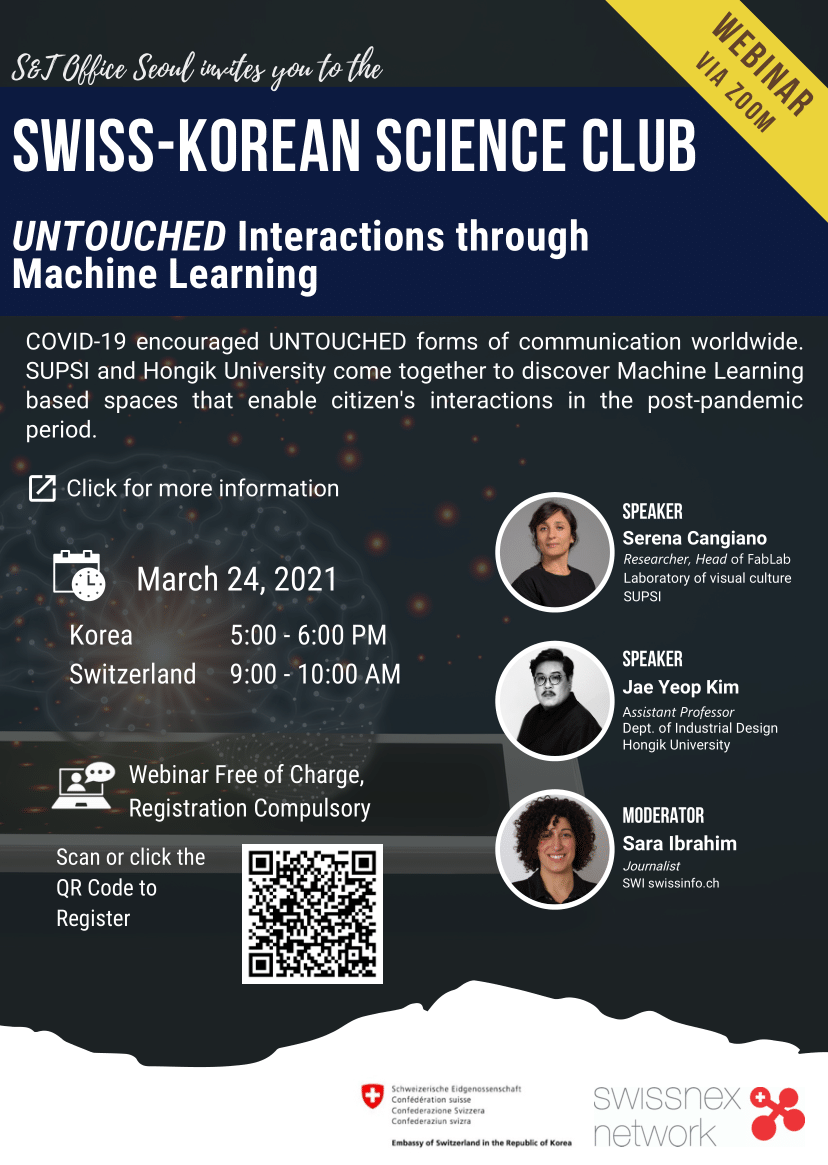

Volete saperne di più su come il Machine Learning può rendere possibili le interazioni dei cittadini nell’era post pandemica? Allora non perdete l’evento “Untouched interaction through Machine Learning” (interazione senza contatti attraverso il Machine Learning) organizzato dallo Swiss-Korean Science Club, una piattaforma creata dall’ufficio di Scienza e Tecnologia dell’Ambasciata svizzera in Corea del Sud per illustrare gli ultimi sviluppi dei progetti di ricerca tra Svizzera e Corea del Sud.

Io sarò presente all’evento in qualità di moderatrice e vi invito caldamente a partecipare!

Quando? Il 24 marzo 2021, alle 9.00 am CET

Dove? Online, via Zoom

Come?Registratevi qui!Collegamento esterno

Robot nello spazio…e l’uomo dov’è?

Dopo l’atterraggio del rover americano Perseverance su Marte, ritorna la questione del “sogno marziano”, ovvero dell’abitabilità del pianeta rosso da parte dell’uomo. Gli esperti si dividono tra chi crede che l’uomo potrà vivere su Marte, un giorno, e chi vede troppi ostacoli all’orizzonte.

Segnatevi la data! Il 15 aprile SWI swissinfo.ch ospiterà un dibattito dal vivo su questo tema con gli esperti Sylvia Ekström, Javier G. Nombela e Pierre Brisson. Se avete delle domande che vorreste sollevare durante il dibattito, inviatemele! Vi daremo più dettagli in una prossima edizione di questa newsletter e su swissinfo.ch.

Seguiteci su TwitterCollegamento esterno o FacebookCollegamento esterno per saperne di più

In conformità con gli standard di JTI

Altri sviluppi: SWI swissinfo.ch certificato dalla Journalism Trust Initiative

Partecipa alla discussione!