¿Qué pasa cuando Google se deshace de la ética?

Según investigadores suizos que trabajan en el sector, los gigantes tecnológicos como Google no son plenamente conscientes del poder de las herramientas de inteligencia artificial que están construyendo. El reciente y sonado despido de una experta en ética de Google pone en duda que entre las principales prioridades de las grandes tecnológicas realmente esté un código moral en torno a la inteligencia artificial (IA).

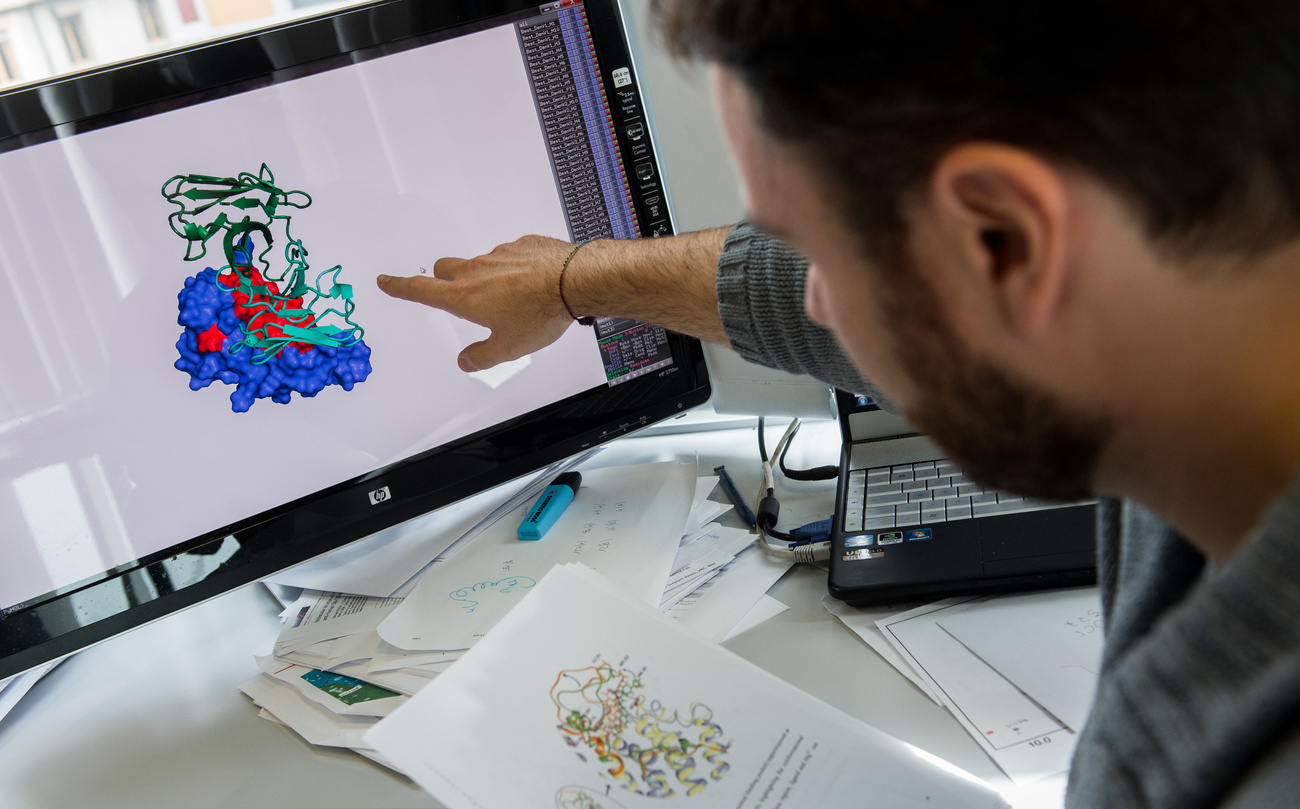

“Los algoritmos en los que trabajamos son una cuestión de interés público, no de afinidades personales”. Esto es lo que el único empleado de Google Brain en Europa que trabaja con el equipo de Inteligencia Artificial Ética, El Mahdi El Mhamdi, ha dicho en Twitter sobre el sonado despido de un día para otro de su jefa, Timnit Gebru, en diciembre de 2020. Google Brain es un equipo de investigación de Google cuyo objetivo es replicar el funcionamiento del cerebro humano mediante sistemas de aprendizaje profundo.

Gebru está considerada como uno de los investigadores más brillantes en el campo de la inteligencia artificial ética. En un artículoEnlace externo escrito junto con otros investigadores, advierte sobre los peligros morales de los grandes modelos de lenguaje, que son la base del motor de búsqueda de Google y de su negocio.

Nacida en Addis Abeba (Etiopía) de padres eritreos, Timnit Gebru llegó a Estados Unidos con 15 años como refugiada durante la guerra entre Etiopía y Eritrea. Más tarde ingresó en la Universidad de Stanford y se doctoró en Visión por Ordenador en el Laboratorio de Inteligencia Artificial de Stanford. Su tesis sobre el uso de imágenes públicas a gran escala para realizar análisis sociológicos alcanza cierto éxito, llegando a las páginas de The New York Times y The Economist. Su consagración llega cuando copublica una investigación pionera que demuestra la inexactitud y la discriminación de los sistemas de reconocimiento facial contra las mujeres y las personas de color. En 2018, Gebru trabajaba para Microsoft Research cuando Google la contrata como colíder para crear el equipo de Inteligencia Artificial Ética.

Gebru está considerada como uno de los investigadores más brillantes en el campo de la inteligencia artificial ética. En un artículoEnlace externo escrito junto con otros investigadores, advierte sobre los peligros morales de los grandes modelos de lenguaje, que son la base del motor de búsqueda de Google y de su negocio.

"Google’s short-sighted decision to fire and retaliate against a core member of the Ethical AI team makes it clear that we need swift and structural changes if this work is to continue…1\https://t.co/ojaCydyS6fEnlace externo

— Timnit Gebru (@timnitGebru) December 17, 2020Enlace externo

Otros investigadores también han descubierto y destacado los riesgos de la evolución incontrolada de los sistemas de inteligencia artificial. Alexandros Kalousis, profesor de Minería de Datos y Aprendizaje Automático en la Universidad de Ciencias Aplicadas de Suiza Occidental, dice que hay “un elefante en la habitación” [metáfora para referirse a un problema evidente del que nadie quiere discutir]. “La IA está en todas partes y avanza a gran velocidad; sin embargo, muy a menudo los desarrolladores de herramientas y modelos de IA no son realmente conscientes de cómo se comportarán cuando se desplieguen en entornos complejos del mundo real. La materialización de las consecuencias perjudiciales llega después, si es que llega”, alerta.

Wtf @GoogleEnlace externo @GoogleAIEnlace externo??

— Lê Nguyên Hoang (Science4All) (@le_science4all) February 28, 2021Enlace externo

Before deploying any larger language models, are you confident that such a dangerous misinformation, probably ubiquitous in your training dataset, will not be repeated by your algorithms?

How does firing your ethics team help you make "responsible AIs"? https://t.co/9Fw8bOHonCEnlace externo

Pero, como demostró la experiencia de Gebru, los investigadores que predicen esas consecuencias y dan la voz de alarma no siempre son aceptados por las empresas para las que trabajan.

“Timnit Gebru fue contratada por Google para ocuparse de la ética de la inteligencia artificial y fue despedida por ocuparse de la ética de la inteligencia artificial. Esto demuestra lo mucho que le importan a la empresa las cuestiones éticas”, afirma Anna Jobin, investigadora del Instituto Humboldt de Internet y Sociedad de Berlín y experta en ética de las nuevas tecnologías. “Si tratan así a una especialista en ética de la inteligencia artificial públicamente conocida, ¿cómo puede esperar Google ser más ético?”.

If a company cannot even pretend to care about its internal "Ethical AI" co-leader, how much do you think they care about the rest of us?

— Dr. Anna Jobin (@annajobin) December 9, 2020Enlace externo

In the wake of Google's outing of @timnitgebruEnlace externo, my two cents on #AIethicsEnlace externo #BigTechEnlace externo #IStandWithTimnitEnlace externo: https://t.co/xzxlaNwPvCEnlace externo

‘Paripé ético’

Gebru era un símbolo de una nueva generación de mujeres y líderes negros en el mundo de la tecnología, donde la fuerza de trabajo está dominada por hombres blancos. Junto con su colega Margaret Mitchell –también despedida de la empresa en febrero– había creado un equipo multicultural para investigar y promover el desarrollo ético e inclusivo de los sistemas de inteligencia artificial de Google.

Tras exponer en una guía sus principios de IA éticaEnlace externo, en 2019 Google decidió completar su estructura interna de gobernanza con la creación de un grupo independiente para supervisar el desarrollo de los sistemas de inteligencia artificial de la compañía, el Consejo Asesor Externo de Tecnología Avanzada (ATEAC, por sus siglas en inglés).

“Este grupo considerará algunos de los desafíos más complejos de Google que surgen bajo nuestros Principios de IA, como el reconocimiento facial y la equidad en el aprendizaje automático, proporcionando diversas perspectivas para informar nuestro trabajo. Estamos deseando colaborar con los miembros de ATEAC en relación con estas importantes cuestiones”, escribió el vicepresidente de Asuntos Globales de la compañía, Kent Walker, en el blog de GoogleEnlace externo.

A pesar de estas premisas, menos de dos semanas después de su lanzamiento, el grupo se cerró debido al revuelo que causó el controvertido nombramiento de dos miembros de la junta, uno de ellos considerado un conservador “antitrans, anti-LGTBQ y antiinmigrante”, y la posterior dimisión de otro miembro.

Pero Jobin declara que, a menos que la cuestión se gestione correctamente y que esos equipos estén facultados para actuar en función de sus conclusiones, “la IA ética puede ser una fuerza no ética”, una etiqueta puramente cosmética para enmascarar de forma engañosa un afán de negocio que en realidad está en abierto conflicto con los principios morales. Al igual que ocurre con el green washing (ecoblanqueo), en el que las empresas pregonan pero no actúan sobre las políticas medioambientales, se podría hablar del “blanqueo ético” (o paripé ético), es decir, del escaparate ético. “Sería manifestar: somos éticos, así que dejen de molestarnos”, explica Jobin.

Burak Emir, ingeniero principal de software que desde hace 13 años trabaja para Google en Zúrich, tras el despido de Gebru, se vio obligado a cuestionarse el propósito de la investigación ética de la empresa.

“¿Para qué tenemos un departamento de ética si solo podemos escribir palabras bonitas?”, se pregunta el ingeniero. “Si el objetivo es publicar únicamente investigaciones agradables y bonitas, que no se diga que se hace para aumentar el conocimiento. Necesitamos más transparencia”, añade.

It took me a while (sorry), but I read up on available info & came around to think that @timnitgebruEnlace externo's reaction makes sense. The demands formulated here are reasonable, and research leadership has to move to regain trust.https://t.co/2Wc3ImG0g7Enlace externo#ISupportTimnitEnlace externo #BelieveBlackWomenEnlace externo

— Burak Emir (@burakemir) December 6, 2020Enlace externo

Muchos científicos e investigadores han expresado su solidaridad con Gebru, incluidos algunos que viven y trabajan en Suiza. En Zúrich se encuentra el mayor centro de investigación de Google fuera de Estados Unidos. Y se centra, entre otras cosas, en el aprendizaje automático y en la inteligencia artificial. Emir es uno de los más de 2 600 empleados de la empresa que han firmado una petición en apoyo a GebruEnlace externo y que cuestiona el enfoque de la empresa sobre la inteligencia artificial ética.

El hábito no hace al monje

Google niega haber “censurado” a Gebru. Cuando SWI swissinfo.ch se ha puesto en contacto con Google Suiza, su oficina de comunicación nos ha remitido a declaraciones oficiales realizadas con anterioridad por ejecutivos de Google. Una de esas declaracionesEnlace externo es la de Jeff Dean, jefe de Inteligencia Artificial de Google, que dijo que la investigación firmada por Gebru no cumplía los requisitos de publicación y que la empresa no la despidió, sino que aceptó su dimisión, que Gebru asegura que nunca presentó.

I understand the concern over Timnit’s resignation from Google. She’s done a great deal to move the field forward with her research. I wanted to share the email I sent to Google Research and some thoughts on our research process.https://t.co/djUGdYwNMbEnlace externo

— Jeff Dean (@JeffDean) December 4, 2020Enlace externo

I was fired by @JeffDeanEnlace externo for my email to Brain women and Allies. My corp account has been cutoff. So I've been immediately fired 🙂

— Timnit Gebru (@timnitGebru) December 3, 2020Enlace externo

Roberta Fischli, investigadora de la Universidad de San Galo, que también ha firmado la petición de apoyo a Gebru, afirma que, desde el despido de la investigadora de ética, la imagen de Google se ha resentido dentro de la comunidad de IA y ética. Fischli cree que cuando se hace una investigación que cuestiona las prácticas existentes en una empresa el conflicto de intereses es inevitable, por lo que desde el principio había cierto riesgo.

“En teoría, a la mayoría de las empresas les gusta tener investigadores críticos. Pero en la práctica, sin quererlo, si los investigadores empiezan a criticar a su empleador se produce un choque de intereses”, dice. Y Fischli señala que los investigadores que buscan hacer un trabajo innovador sobre la IA ética a menudo no tienen muchas opciones y acaban en empresas privadas, porque es donde se concentran más recursos. “Así que intentan entender mejor ciertos mecanismos y cambiar las cosas desde dentro, lo que no siempre acaba bien”.

Tras el despido de Gebru, el gigante de internet ha continuado su actividad aparentemente sin alteraciones, pero algo se está moviendo. En enero, un grupo de empleados de la empresa en Estados Unidos formó el primer sindicato de la historia en una gran multinacional tecnológica, el Alphabet Workers UnionEnlace externo. Posteriormente, los empleados de Google de todo el mundo crearon una alianza sindical global en 10 países, incluidos el Reino Unido y Suiza.

Hard to understate the importance of this against the background of @timnitGebruEnlace externo’s forced departure from #GoogleEnlace externo’s AI Ethics team. Time to take ethics, diversity and labor law – and your own corporate slogan seriously, Google! #ISupportTimnitEnlace externo https://t.co/H0AORkHKE0Enlace externo

— Roberta Fischli (@leonieclaude) December 3, 2020Enlace externo

El elefante en la habitación

Pero la influencia de Google y del llamado grupo GAFA (acrónimo de Google, Amazon, Facebook y Apple) se extiende mucho más allá de los confines de las oficinas de las empresas. Lo que estos gigantes tecnológicos hacen y planifican también dicta la agenda de investigación académica mundial. “Es difícil encontrar análisis en las grandes instituciones académicas y de investigación que no estén vinculados o incluso financiados por las grandes empresas tecnológicas”, afirma Alexandros Kalousis, de la Universidad de Ciencias Aplicadas de Suiza Occidental.

Dada esta influencia, Kalousis considera crucial que haya voces independientes y “fuera de lo establecido” que destaquen los peligros de la explotación incontrolada de datos por parte de los gigantes tecnológicos.

“Este es el gran problema de nuestra sociedad”, asegura Kalousis. “Los debates sobre la ética a veces pueden ser una distracción” de este control omnipresente de los gigantes tecnológicos.

¿Puede la investigación ser tan independiente como debería para cuestionar objetivamente los riesgos de un despliegue a gran escala de las tecnologías de inteligencia artificial? Parece que no. El problema va más allá de Google y afecta a todas las empresas del mercado que están desplegando sistemas de IA sin reglas ni límites. Para nosotros esto significa que la tecnología está dictando lo que éticamente es aceptable y lo que no, y esto está moldeando nuestras vidas y nuestra mentalidad.

Traducción del inglés: Lupe Calvo

En cumplimiento de los estándares JTI

Mostrar más: SWI swissinfo.ch, certificado por la JTI

Únase a la conversación