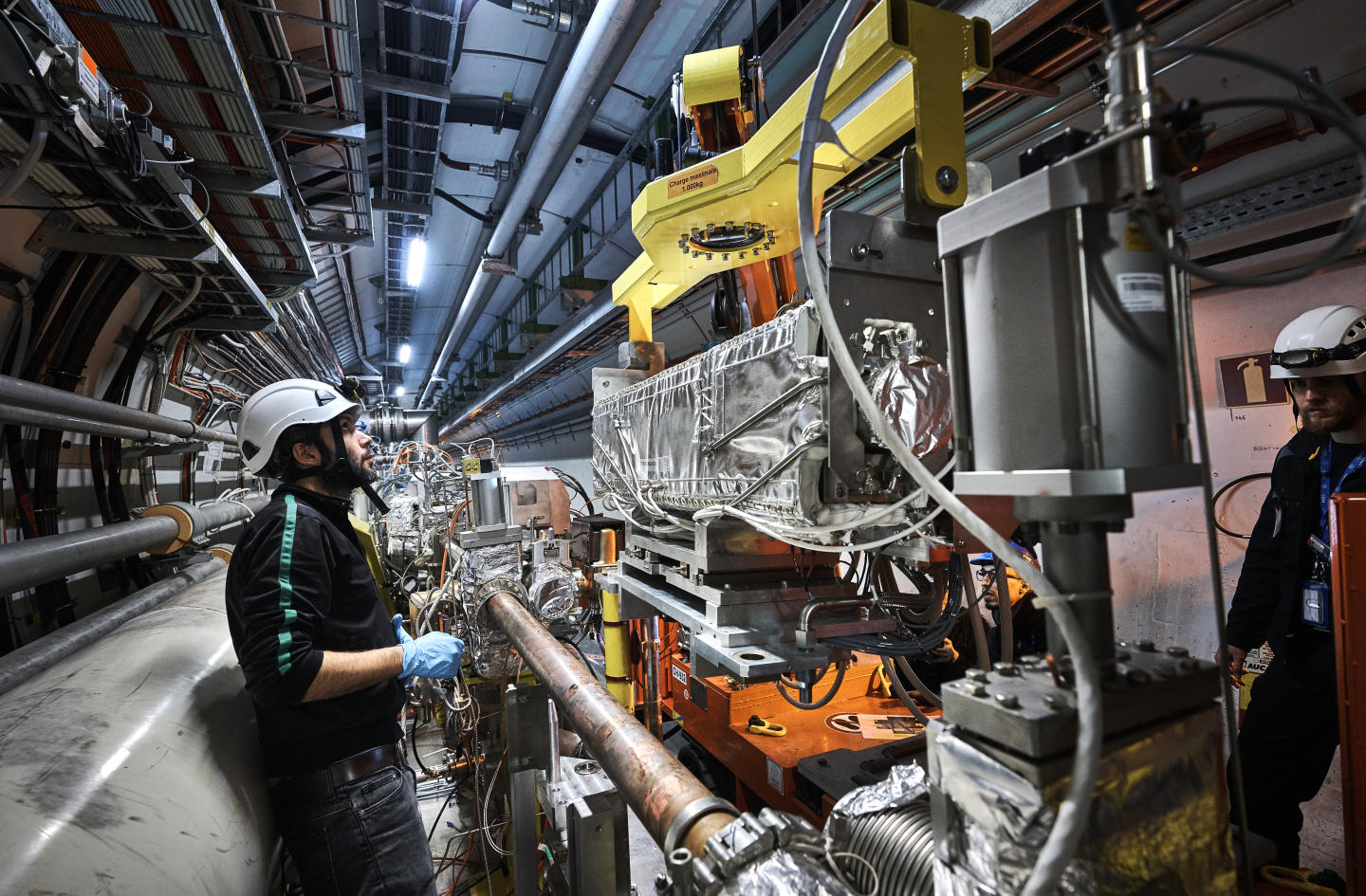

Gli scienziati stanno ridefinendo il successo

Graduatorie universitarie, articoli pubblicati nelle riviste specialistiche, numero di citazioni: qualcuno mette in dubbio i metodi per determinare qual è la scienza "migliore", poiché li giudica obsoleti e controproducenti. La Svizzera intende promuovere sistemi alternativi, ma incontra varie difficoltà.

Stando all’ultimo rapporto del Consiglio svizzero della scienza (CSS), le attività scientifiche, quali l’assunzione di ricercatori, la pubblicazione di studi o gli investimenti pubblici o privati, sono aumentati in maniera notevole negli ultimi decenni. A sua volta, questa tendenza ha accresciuto la competizione tra i vari atenei a un livello mai visto prima; una gara per accaparrarsi fondi, premi, spazi sulle riviste più prestigiose e altri simboli del proprio successo in campo scientifico.

“Pubblicare o morire” è una formula che evidenzia in maniera molto calzante la pressione a cui sono sottoposte le università. E così si dà sempre più importanza ai metodi per misurare, in maniera quantitativa, il successo scientifico [vedi riquadro], tra cui il fattore di impatto di citazioni in articoli pubblicati in periodici scientifici.

I più comuni indicatori della performance scientifica

- Indice HCollegamento esterno: è un criterio di valutazione standardizzato, basato sia sul numero di articoli scientifici pubblicati da un ricercatore sia sul numero di volte che gli articoli sono stati citati. L’indice H quantifica sia la prolificità sia l’influsso su uno specifico settore esercitato da un ricercatore. C’è chi mette in dubbio l’indice H come criterio di valutazione dell’importanza di uno scienziato in un particolare ambito di ricerca. Per esempio, Albert Einstein non appare nella classifica dei fisici più influenti.

- Fattore di impatto delle rivisteCollegamento esterno (journal impact factor, JIF): è usato per paragonare e classificare i periodici scientifici in base alla loro importanza nei loro rispettivi ambiti. Il JIF è un indice che misura il numero medio di citazioni in un anno di articoli pubblicati in una rivista scientifica nei due anni precedenti. Il JIF è uno strumento di valutazione semplice, ma anche imperfetto: per esempio, non valuta la qualità degli articoli e non è sempre possibile fare un confronto tra gli articoli di materie scientifiche diverse. Inoltre, alcuni premi Nobel hanno ricordato che è la ricerca, non la rivista su cui viene pubblicata, ad essere importante.

- Ranking delle universitàCollegamento esterno: si può basare sul trasferimento di conoscenze e citazioni, come sulla qualità dell’insegnamento dei professori. Le classifiche sono diventate sempre più importanti vista l’accresciuta competizione tra atenei per accaparrarsi fondi, studenti e scienziati. C’è chiCollegamento esterno sostiene che queste classifiche spingano le università a puntare sul fattore d’impatto piuttosto che sulla qualità dell’insegnamento.

Durante una recente conferenzaCollegamento esterno tenuta a Berna, Antonio Loprieno, presidente delle Accademie svizzere delle scienze, lo ha definito un “paradosso” della scienza moderna.

“Da una parte si registra un crescente impiego di metodi per misurare la performance scientifica e un aumento dei finanziamenti destinati alla ricerca scientifica: due fenomeni preoccupanti. Dall’altra parte nutriamo dei dubbi sulla equità, validità e applicabilità degli strumenti di valutazione”, indica Loprieno.

Per chiarire questi dubbi, il CSS ha pubblicato quest’anno delle raccomandazioniCollegamento esterno (in formato PDF) per la comunità scientifica della Svizzera in cui presenta possibili strategie per cambiare il metodo di valutazione e di finanziamento della ricerca, in particolare utilizzando indicatori qualitativi a sostegno di quelli quantitativi. “Ultimamente, gli indicatori quantitativi sono stati impiegati in maniera sempre più frequente in sostituzione di quelli qualitativi; una pratica che ha creato incentivi sbagliati tra i ricercatori a scapito della qualità scientifica”, si legge nel rapporto.

“Andrebbe promossa una strategia nazionale che tenga conto della molteplicità delle discipline e dei requisiti istituzionali affinché sia possibile fare una valutazione differenziata”.

Più di un numero

I critici sostengono che alle valutazioni quantitative viene conferita un’importanza esagerata, tendenza che porta a un deterioramento del rigore scientifico, ciò che dovrebbe invece essere l’obiettivo principale perseguito da questi criteri di giudizio. Inoltre, gli scienziati sono sottoposti a uno stress enorme.

“Stando al motore di ricerca Google, il mio indice H è 48. Questo numero indica che 48 articoli riportano almeno 48 mie citazioni. Non mi piace essere ridotto a un semplice numero”, indica Stephen Curry, professore di biologia strutturale presso la prestigiosa università Imperial College London, e presente come relatore alla conferenza tenuta a Berna.

“Si possono usare dei numeri per caratterizzarla, ma la scienza è in fondo un’attività profondamente umana. Non si può dare un valore numerico alla qualità scientifica: deve essere fatta tramite una valutazione, una discussione e coinvolgendo degli esperti”.

Stephen Curry dirige il comitato della Dichiarazione di San Francisco sulla valutazione della ricerca (in inglese, San Francisco Declaration on Research Assessment; DORACollegamento esterno). È una delle tante iniziative volte a ridare lustro alle valutazioni della scienza. DORA intende formulare nuove linee guida per giudicare i ricercatori e gli istituti in maniera più completa ed efficiente, favorendo così i progressi in campo scientifico.

Misurare la qualità

I critici sostengono che gli indicatori quantitativi, come l’indice H, sono soggetti a una distorsione e i metodi di calcolo usati non sono sufficientemente trasparenti. Questi metodi favorirebbero le ricerche classiche, scoraggiando invece quelle alternative, ad alto rischio ma con un elevato potenziale.

Per Ellen Hazelkorn, capo dell’Unità di ricerca sulle politiche di istruzione superiore presso l’Institute of Technology di Dublino, queste valutazioni sono problematiche soprattutto nel momento in cui la scienza è destinata a tutti e non solo per una élite chiusa in una torre d’avorio.

La professoressa aggiunge che le valutazioni da cui scaturiscono i ranking delle università, per esempio le tanto attese classifiche annuali del Times Higher Education World University RankingsCollegamento esterno, non promuovono un’ampia partecipazione della società, bensì responsabilizzano soltanto gli atenei e non l’intera società.

“Le classifiche sono semplici da capire, ma i loro indicatori di successo aumentano i livelli di ineguaglianza e di stratificazione sociale, che a loro volta si ripercuotono sull’accesso ai beni pubblici”, sostiene Ellen Hazelkorn.

Secondo Curry, è soprattutto la semplicità a suscitare tanto fascino nei confronti degli standard di valutazione dei ricercatori e delle qualità delle riviste come il numero di citazioni e i fattori di impatto dei periodici. “Gli indicatori sono facili da calcolare: ad affascinarci sono la pseudo-obiettività e il fatto che ci facilitano la vita”, sostiene Stephen Curry.

Pressione e prestigio

Ma a quale prezzo? Curry spiega che il fatto di concentrarsi troppo su questi criteri può frenare il progresso scientifico poiché i ricercatori sono incoraggiati a sottoporre le loro ricerche ai periodici più prestigiosi, correndo però il rischio di non vedere pubblicati i loro articoli o di dover ritrattare le loro conclusioni, una situazione che mette in cattiva luce la ricerca.

Focalizzare l’attenzione sulle pubblicazioni o sul prestigio sminuisce inoltre altre attività importanti, quali l’insegnamento, la comunicazione e la divulgazione scientifica oppure l’assistenza dei giovani ricercatori.

Finora, la Dichiarazione di San Francisco sulla valutazione della ricerca è stata firmata da quasi 14mila persone e organizzazioni. Il decalogo per la valutazione scientifica “ManifestoCollegamento esterno di Leiden” gode sempre di maggiore sostegno tra gli accademici. Entrambi i documenti formulano delle proposte per ridurre il ricorso agli standard quantitativi di qualità o di impiegarli in combinazione con altri criteri per valutare la qualità dei contenuti scientifici.

Metodi alternativi sempre più in voga

Tutti voglio eccellere nel mondo scientifico, un mondo in rapida evoluzione. E allora come fare a diffondere standard di qualità che puntino su una valutazione globale, ma che richiedono più tempo rispetto a quelli attuali?

Per Sarah de Rijcke, vice direttrice del Centro di studi di scienze e tecnologie dell’Università di Leiden, nei Paesi Bassi, la culla del Manifesto di Leiden, indica che una possibile soluzione può essere trovata con quello che lei definisce un “approccio di portafoglio”, una valutazione che inquadra la situazione, l’istituzione e il ricercatore.

“Le regole universali non sono molto efficaci”, sostiene Rijcke. Stando alla scienziata, i tipi di ricerca che ottengono i punteggi migliori con i metodi di valutazione tradizionali variano da una disciplina all’altra. Per inserirle in un contesto, Rijcke raccomanda di applicare principi complessivi per creare una “narrazione standardizzata”, che intrecci le competenze di uno scienziato, i risultati (pubblicazioni, borse di studio per insegnare, attività nei social media), l’impatto scientifico e l’influsso sociale.

Il comitato DORA raccoglie esempi di modelli di valutazione simili, chiedendo, per esempio, ai ricercatori di descrivere brevemente e con parole proprie i loro contributi e le loro pubblicazioni migliori nel Curriculum Vitae (biosketchCollegamento esterno).

La responsabilità svizzera

Antonio Loprieno spiega a swissinfo.ch che la Svizzera si sente in obbligo di promuovere un cambiamento a livello internazionale visti i vari finanziamenti e i requisiti amministrativi più snelli e flessibili rispetto ad altri Paesi europei.

“Penso che abbiamo una certa responsabilità nei confronti del resto del mondo poiché abbiamo la fortuna di avere un ottimo sistema di finanziamento. La Svizzera potrebbe sperimentare o provare soluzioni in modo proattivo per risolvere le difficoltà del sistema attuale”, dice il presidente dell’Accademia svizzera di scienze naturali.

Secondo Loprieno, una delle maggiori sfide consiste nel sostenere in maniera adeguata i giovani ricercatori durante il periodo di transizione dagli standard di valutazione tradizionali a quelli che cercano di tracciare un quadro olistico della performance scientifica.

“La mia soluzione è più aperta nei confronti delle ricerche a lungo termine. Attualmente sosteniamo e finanziamo piuttosto progetti di breve durata poiché ragioniamo ancora in termini di competizione. Se fossimo disposti a promuovere iniziative di ricerca sul lungo termine, ciò ridurrebbe la pressione sui giovani e creerebbe un sistema più equo”.

Traduzione dall’inglese: Luca Beti

In conformità con gli standard di JTI

Altri sviluppi: SWI swissinfo.ch certificato dalla Journalism Trust Initiative

Potete trovare una panoramica delle discussioni in corso con i nostri giornalisti qui.

Se volete iniziare una discussione su un argomento sollevato in questo articolo o volete segnalare errori fattuali, inviateci un'e-mail all'indirizzo italian@swissinfo.ch.