Inteligência artificial é tão inteligente como pensamos?

Computadores tomam decisões cada vez mais importantes para seus usuários. Devemos dar-lhes essa liberdade? Pesquisadores do Instituto Idiap mostram porque a inteligência artificial pode ser apenas uma ilusão.

Máquinas podem pensar? É com esta pergunta que o matemático britânico Alan Turing abre sua obra mais famosa. Publicado em 1950, o texto lançou as bases para a concepção e definição de inteligência artificial (IA). Para responder à pergunta, Turing inventou o ‘jogo de imitação’, ainda hoje usado para julgar a inteligência de uma máquina.

O jogo, mais tarde conhecido como o Teste de Turing, envolve três jogadores: o jogador A é um homem, o B é uma mulher e o C, que desempenha o papel de interrogador, pode ser de qualquer sexo.

O interrogador não pode ver os outros dois jogadores e faz uma série de perguntas por escrito para determinar qual jogador é o homem, e qual é a mulher. O objetivo do interrogado masculino é enganar o interrogador, dando respostas enganosas. O da mulher é de facilitar sua correta identificação.

Imagine que o jogador A seja substituído por um computador. Turing escreveu que se o interrogador é incapaz de distinguir entre um computador e uma pessoa, o computador deve ser considerado uma entidade inteligente, uma vez que seria cognitivamente semelhante a um ser humano.

Setenta anos depois, os resultados do teste são assombrosos. “No momento, não há um único sistema de inteligência artificial que tenha passado no primeiro teste de Turing”, diz Hervé Bourlard, que dirige o Idiap, o instituto de pesquisa sediado em Martigny, a capital do cantão do Valais, especializado em inteligência artificial e cognitiva.

Mostrar mais

Quando algoritmos ajudam a escolher o melhor candidato

Nem artificial, nem inteligente

Tendo caído em desuso já nos anos 1970 – sendo considerado antiquado e ridículo – o termo inteligência artificial voltou à moda nos anos 1990, “por razões de publicidade, marketing e negócios”, diz Bourlard, que também é professor de engenharia elétrica. “Mas sem ter feito nenhum progresso real, exceto nos modelos matemáticos”. Bourlard permanece cético sobre a expressão e seu uso hoje em dia.

Segundo o professor, não existe “inteligência artificial” porque nenhum sistema reflete a mais leve inteligência humana. Mesmo um bebê de dois ou três meses de idade pode fazer o que a IA nunca seria capaz de fazer.

Um exemplo? Vamos tomar um copo de água deitado sobre uma mesa. Uma criança pequena sabe que se for virada de cabeça para baixo, o copo de água se torna um copo vazio. “É por isso que ela gosta de derramar. Nenhuma máquina no mundo pode entender esta diferença”, diz Bourlard. O que este exemplo demonstra também se aplica ao bom senso, uma capacidade que distingue os seres humanos de outros seres vivos, mas que as máquinas não podem e – segundo Bourlard – nunca serão capazes de imitar.

Inteligência está nos dados

Entretanto, a IA está bem estabelecida em muitos setores empresariais e contribui cada vez mais para os processos de tomada de decisão em campos como recursos humanos, seguros e empréstimos bancários, dentr outros.

Ao analisar o comportamento humano na Internet, as máquinas aprendem quem somos e do que gostamos. Os sistemas de recomendação filtram informações menos relevantes e recomendam filmes para assistir, notícias para ler ou roupas que podemos gostar nas mídias sociais.

Mas isso ainda não torna a inteligência artificial inteligente, ressalta Bourlard, que se tornou chefe do Idiap em 1996. O professor prefere falar sobre a aprendizagem de máquinas. Segundo Bourlard, há três aspectos que tornam a IA poderosa à sua própria maneira: poder computacional, modelos matemáticos e bancos de dados muito grandes e difundidos.

Computadores cada vez mais potentes e a digitalização de informações tornaram possível melhorar enormemente os modelos matemáticos. A Internet com seus infinitos bancos de dados tem feito o resto, empurrando as capacidades dos sistemas de IA cada vez mais longe.

Os pesquisadores da Idiap mostram ao público como funciona a IA e o que ela pode fazer:

Idiap procura mostrar ao público como os dados são centrais para as máquinas através de uma série de apresentações, realizadas no Museu da MãoLink externo a partir de 1 de abril de 2022, em Lausanne.

O público terá a oportunidade, por exemplo, de experimentar como a tecnologia baseada em IA por trás das câmeras de celulares pode melhorar significativamente a qualidade das imagens de baixa resolução ou, inversamente, piorá-las, dependendo dos dados com os quais foi treinado.

Este não é um processo fácil, mas requer muitos dados de boa qualidade que devem ser anotados, ou “etiquetados”, por um humano (embora não totalmente manualmente) para torná-los compreensíveis para uma máquina. “Não estamos lidando com algo que tem vida própria, mas com um sistema que é alimentado com dados”, afirma Michael Liebling, que dirige o Grupo de Bioimagem Computacional da Idiap.

Isto não significa que a IA não tenha riscos. Os limites das máquinas dependem dos limites dos dados. Isto, segundo Liebling, deveria fazer as pessoas pensarem onde está o perigo real. O perigo está realmente em uma máquina de ficção científica tomando conta do mundo? Ou está na forma como distribuímos e anotamos os dados? Pessoalmente, acho que a ameaça está na forma como os dados são gerenciados e não nas próprias máquinas”, diz Liebling.

Mais transparência necessária

Gigantes tecnológicos como Google e Facebook estão bem cientes do poder dos grandes modelos alimentados por dados e construíram seus negócios em cima deles. Este aspecto, juntamente com a automação de algumas tarefas humanas, é o que mais preocupa a comunidade científica. O informático Timnit Gebru foi até demitido da Google por criticar os modelos de linguagem muito grandes e inescrutáveis subjacentes ao mecanismo de busca mais usado no mundo.

A limitação dos modelos de aprendizagem de máquinas é que eles não mostram – ou pelo menos ainda não mostram – uma capacidade de raciocínio igual à nossa. Eles são capazes de fornecer respostas, mas não de explicar por que chegaram a uma determinada conclusão. “Você também precisa torná-los transparentes e compreensíveis para um público humano”, diz André Freitas, que dirige o grupo de pesquisa de Raciocínio e Explicação da IA no Idiap.

A boa notícia, diz Freitas, é que a comunidade AI – que no passado se concentrava principalmente em melhorar o desempenho e a precisão dos sistemas – agora também faz pressão para desenvolver modelos éticos, explicáveis, seguros e justos.

Com seu grupo de pesquisa, Freitas está construindo modelos de IA que podem explicar suas inferências. Isto tornaria possível não apenas prever e recomendar quando pacientes Covid-19 positivos deveriam ser admitidos em UTIs, mas também expor a equipe médica usando o modelo a como estas conclusões foram alcançadas e quais são as possíveis limitações do sistema.

“Construindo modelos de IA capazes de se explicar para o mundo exterior, podemos dar aos usuários as ferramentas para ter uma visão crítica sobre suas limitações e pontos fortes”, diz Freitas. O objetivo é transformar algoritmos complexos e jargões técnicos em algo compreensível e acessível. Quando as aplicações de IA começam a permear nossas vidas, o pesquisador recomenda: ‘Se você se deparar com um sistema de IA, desafie-o a se explicar’.

Mostrar mais

Quando Google deixa de ser ética

Ilusões de inteligência

IA é muitas vezes descrita como o motor por trás das inovações. É, portanto, natural que desperte excitação e grandes expectativas. Graças aos modelos de redes neurais, que são inspirados pelo cérebro humano, os computadores funcionam bem em áreas que antes eram impensáveis.

“Isto nos levou a acreditar que a IA se tornará tão inteligente quanto nós e resolverá todos os nossos problemas”, diz Lonneke van der Plas, que lidera o grupo de Computação, Cognição e Linguagem da Idiap.

Van der Plas dá o exemplo das capacidades cada vez mais avançadas dos sistemas lingüísticos, tais como assistentes virtuais ou ferramentas de tradução automática. Eles nos deixam sem palavras e pensamos que se um computador pode se envolver em algo tão complexo como a linguagem, deve haver inteligência por trás dele”, diz.

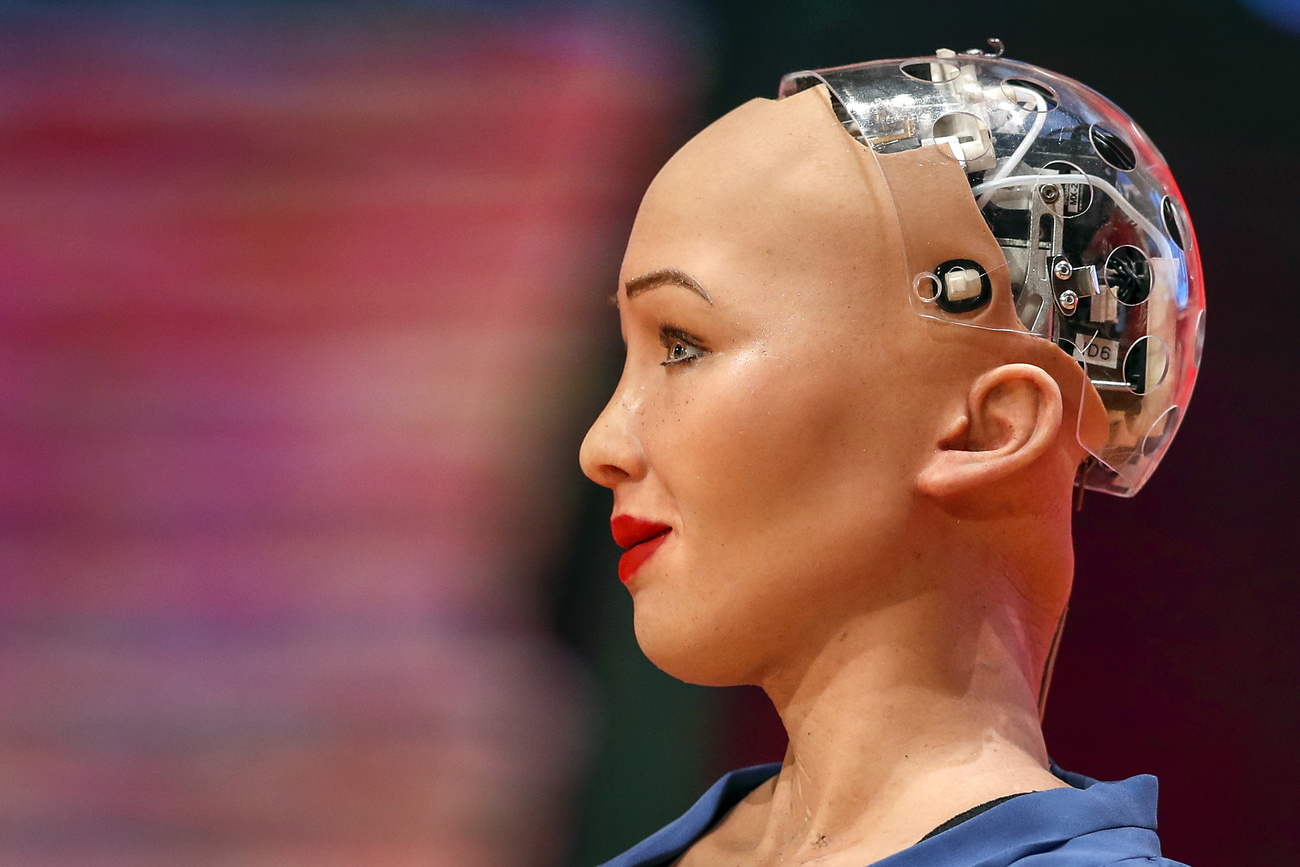

As ferramentas linguísticas podem nos imitar, porque os modelos subjacentes são capazes de aprender padrões a partir de um grande volume de textos. Mas se compararmos as capacidades de um assistente virtual (ativado por voz) com as de uma criança comum em uma discussão sobre um avião de papel, por exemplo, o software precisa de muito mais dados para alcançar o nível da criança – e até mesmo terá dificuldade para se expressar usando o bom senso. “É fácil enganar a nós mesmos, porque parecer um ser humano não significa automaticamente que exista uma inteligência humana por trás dele”, diz Van der Plas.

Afinal, Turing disse-o há setenta anos: não vale a pena tentar humanizar uma “máquina pensante” através de dispositivos estéticos. O valor de um livro não é julgado pela sua capa.

Adaptação: Alexander Thoele

Mostrar mais

Certificação JTI para a SWI swissinfo.ch

Mostrar mais: Certificação JTI para a SWI swissinfo.ch

Veja aqui uma visão geral dos debates em curso com os nossos jornalistas. Junte-se a nós!

Se quiser iniciar uma conversa sobre um tema abordado neste artigo ou se quiser comunicar erros factuais, envie-nos um e-mail para portuguese@swissinfo.ch.