Científicos suizos a la caza de ultrafalsificaciones

A medida que los videos manipulados con inteligencia artificial (IA) son cada vez más sofisticados, expertos en Suiza reevalúan los riesgos que su uso malicioso representa para la sociedad y desarrollan herramientas innovadoras para arrestar a sus autores.

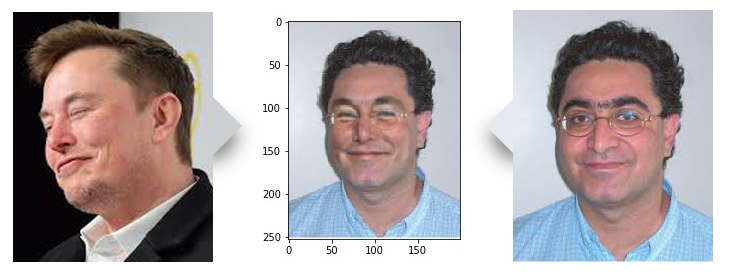

En un laboratorio de computación en el campus de la Escuela Politécnica Federal de Lausana (EPFL), el equipo de ingenieros del Multimedia Signal Processing Group (Grupo de Procesamiento de Señal Multimedia) contempla la imagen de un hombre sonriente, con gafas, tez rosada y rizos oscuros.

“Sí, esa es buena”, asienta el investigador en jefe, Touradj Ebrahimi, que se parece un poco al hombre en la pantalla. El equipo mezcló su retrato con el de Elon Musk, el fundador de Tesla, para crear una ultrafalsificación (deepfake): una imagen digital o video creado con inteligencia artificial.

Esta es una de las muchas falsificaciones, algunas más realistas que otras, que el equipo de EbrahimiEnlace externo ha creado mediante el desarrollo de un software, en colaboración con la empresa de ciberseguridad Quantum IntegrityEnlace externo (QI), que puede detectar imágenes alteradas, incluidas las ultrafalsificadas.

Con el empleo del “aprendizaje automático”, el mismo procedimiento de las ultrafalsificaciones, el software aprende a diferenciar entre lo genuino y lo falsificado: un “creador” lo alimenta con imágenes falsas, que un “detector” intenta encontrar.

“Con mucho entrenamiento, este programa puede ayudar a detectar falsificaciones como lo haría un humano”, detalla Ebrahimi. “Cuanto más se usa, mejor se vuelve”.

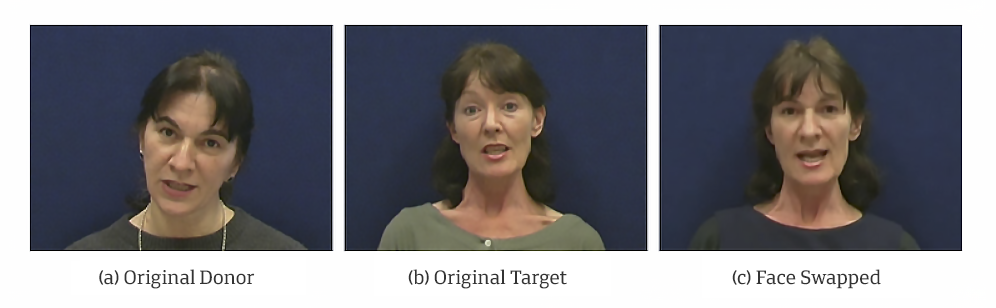

Fotos y videos falsificados han existido desde hace mucho tiempo. Pero apenas recientemente las técnicas de IA han permitido a los falsificadores modificar rostros en un video o hacer que parezca que la persona está diciendo palabras que nunca ha dicho. En los últimos años, la tecnología de ultrafalsificación se ha desarrollado más rápido de lo que la mayoría de los expertos anticiparon.

La fabricación de videos falsos se ha vuelto “exponencialmente más rápida, más fácil y más barata”, gracias a programas accesibles y fáciles de usar, y a los servicios de pagos, según el Centro Internacional de Gobernanza del Riesgo (IRGC)Enlace externo de la EPFL.

“Es precisamente porque este campo evoluciona tan rápidamente por lo que tenemos que determinar hacia dónde podría conducir, qué sectores, grupos y países podrían verse afectados”, señala el subdirector del IRGC, Aengus Collins.

Gran parte del problema con estas falsas imágenes maliciosas implica su uso en la pornografía y es urgente prepararse para los casos en los que las mismas técnicas sean usadas para manipular a la opinión pública.

Un campo en rápida evolución

Cuando Ebrahimi comenzó a trabajar con QI en el programa de detección hace tres años, los ultrafalsificadores no estaban en el radar de la mayoría de los investigadores. En ese momento, los clientes de QI estaban preocupados por las imágenes falsas de accidentes que conducían a reclamaciones fraudulentas de seguros de automóviles y viviendas. Sin embargo, para el 2019, las ultrafalsificaciones alcanzaron tal nivel de sofisticación que Quantum Integrity decidió dedicarles mucho más tiempo.

“Estoy sorprendido, no esperaba que la tecnología evolucionara tan rápido”, comenta Anthony Sahakian, gerente general de QI.

Sakahian pudo constatar cuán lejos han llegado esas técnicas de ultrafalsificación para lograr resultados realistas. Un ejemplo reciente: el intercambio de caras en una foto de pasaporte que logró dejar intactos todos los sellos del documento.

Además, la cantidad de videos manipulados en línea casi se ha duplicado en nueve meses, llegando a 14 678 en septiembre de 2019, según una estimación de DeeptraceEnlace externo, una compañía holandesa de ciberseguridad.

Áreas de riesgo

La mayoría de los objetivos de las ultrafalsificaciones creadas con la intención de causar perjuicios son mujeres cuyas caras han sido transpuestas a grabaciones, incluidas escenas pornográficas. Este tipo de uso representó el 96% de los videos de ultrafalsificación en línea en 2019, según Deeptrace. Algunos aparecen en sitios dedicados a la pornografía, mientras que otros circulan como «pornos de venganza» para mancillar la reputación de las víctimas.

“El acoso en línea y la intimidación son temas recurrentes”, dice Collins.

Por el contrario, ha habido pocos casos conocidos de ultrafalsificaciones para cometer fraudes. La mayoría han recurrido a la suplantación de voz para engañar a las víctimas y hacer que envíen dinero a los timadores.

Las empresas toman nota. Firmas como Zurich Insurance, Swiss Re y BNP Paribas enviaron representantes a un taller reciente de IRGC sobre riesgos de ultrafalsificación.

El aumento de las ultrafalsificaciones también ha llevado a especular sobre su uso potencial para interferir en procesos políticos.

Esos temores se confirmaron cuando un video manipulado mostró a la presidenta de la Cámara de Representantes de Estados Unidos, Nancy Pelosi, mascullando un discurso. La manipulación fue de baja tecnología, pero como dice Ebrahimi, “es una señal de lo que se puede hacer”.

Crear y detectar

Esta tecnología puede causar pánico en algunos medios, pero no todos están de acuerdo en que los videos falsos sean lo suficientemente realistas como para engañar a la mayoría de los usuarios. Los expertos dicen que la calidad de las ultrafalsificaciones aún depende en gran medida de las habilidades del creador. El intercambio de caras en un video inevitablemente conduce a ciertas imperfecciones en la imagen, explica el experto en seguridad biométrica Sébastien Marcel.

“La calidad será muy variable, dependiendo de la intervención manual realizada para agrandar la imagen”, dice. Si el creador se esfuerza en mejorar el resultado, la falsificación puede ser muy difícil de detectar”

Marcel y sus colegas del Instituto de Investigación IdiapEnlace externo en Martigny, en el cantón del Valais, trabajan en su propio software de detección, como parte de un proyecto sobre la manipulación de rostros y voces en secuencias de video.

“Este problema no se resolverá hoy”, subraya Marcel. Este es un tema de investigación en aumento, por lo que planeamos dedicarle más recursos”.

Para contribuir con el aprovechamiento de algunos resultados iniciales, el instituto sin fines de lucro participa en un desafío lanzado por Facebook para producir un software de detección de ultrafalsificaciones. El gigante de las redes sociales se ha comprometido a pagar más de 10 millones de dólares a investigadores de todo el mundo (ver recuadro).

Pero el objetivo es controvertido.

“Es poco probable hallar una solución milagrosa”, subraya Collins. “Cualquiera que sea el conjunto de técnicas de detección, un adversario hallará la forma de darles la vuelta”.

El juego del gato y el ratón

Ebrahimi y Marcel dicen que su objetivo no es ofrecer una herramienta de seguridad integrada. Parte del trabajo es anticipar la dirección que siguen los manipuladores y los métodos que utilizan para lograrlo.

Marcel prevé un futuro en el que los creadores no solamente podrán cambiar un elemento de un video, como la cara, sino toda la imagen.

“La calidad de las ultrafalsificaciones mejorará, por lo que también debemos mejorar los detectores”, para que la relación costo-beneficio de la fabricación de ultrafalsificadores maliciosos no favorezca a quienes las producen.

Ebrahimi cree que un evento importante, como las próximas elecciones presidenciales en Estados Unidos, podría alentar a los actores maliciosos a acelerar su trabajo.

Pero pueden pasar meses o años antes de que el ojo entrenado ya no pueda detectar una falsificación, dice, y en ese punto, solo las máquinas tendrán la capacidad de distinguir.

Las plataformas de redes sociales toman medidas

Twitter introdujo nuevas regulaciones en marzo de 2020 contra el intercambio de contenido de medios sintéticos o manipulados que pueden causar daño. Entre las medidas está el etiquetado de esos tuits y la difusión de advertencias a los usuarios. YouTube, propiedad de Google, se ha comprometido a no tolerar videos manipulados, relacionados con las elecciones y el censo de EE UU de 2020, que tienen la intención de engañar al público. Facebook ha lanzado un desafío, por un valor de más de 10 millones de dólares, para apoyar a los investigadores de detección en todo el mundo. Facebook y Google han publicado conjuntos de datos de imágenes manipuladas para ayudar a los investigadores a desarrollar técnicas de detección.

Ultrafalsificaciones y entretenimiento

Las ultrafalsificaciones más difundidas son parodias, que involucran a individuos altamente visibles, como celebridades y figuras políticas, según el Centro Internacional de Gobernanza del RiesgoEnlace externo (IRGCL), que enfatiza que «no todos las ultrafalsificaciones se crean con un propósito malicioso». Hollywood también ha desarrollado tecnologías para permitir que los actores fallecidos regresen al cine. Ebrahimi, de la EPFL, dice que, si todo sale según lo planeado, un subproducto del proyecto EPFL/QI podría ser utilizado para crear efectos especiales de películas.

Según el IRGC, otros usos positivos de las técnicas de falsificación incluyen la síntesis vocal con fines médicos y para la medicina forense digital en investigaciones penales.

Traducido del inglés por Marcela Águila Rubín

En cumplimiento de los estándares JTI

Mostrar más: SWI swissinfo.ch, certificado por la JTI

Puede encontrar todos nuestros debates aquí y participar en las discusiones.

Si quiere iniciar una conversación sobre un tema planteado en este artículo o quiere informar de errores factuales, envíenos un correo electrónico a spanish@swissinfo.ch.