瑞士立志研发”类人”人工智能:AI能否真正学会思考?

瑞士开发者已加入全球竞赛,致力于打造能够像人类一样"思考"的人工智能。一些开发者声称,他们正接近重大突破。事实果真如此吗?

閱讀本文繁體字版本請 點擊此處

自2022年ChatGPT公开面世以来,全球掀起了人工智能的新浪潮。中国也迅速加入这一竞赛,今年八月还发布了“人工智能+”国家战略,宣示其在全球AI竞赛中谋求引领地位的雄心。如今,数百万人已习惯于像与人互动那样与AI进行交流。然而,无论中外,迄今还没有任何AI工具被证明具备”人类意义上的智能”。

当前最主流的面向公众的AI平台是基于“大语言模型”(LLMs)构建的,这些模型通过从海量数据中学习到的重复模式来进行预测。其中大多数模型无法像人类思维那样实时学习并适应新信息。苏黎世联邦理工学院(ETH)计算机科学系教授托尔斯滕·霍夫勒(Torsten Hoefler)指出:”它们让我们产生一种错觉,仿佛它们与人类智能水平相当,但这只是统计模拟,而非真正的理解。”

为缩小人类与机器之间的差距,全球各大企业与科研机构正竞相开发所谓的“通用人工智能”(AGI),其定义是达到人类水平的理解力与适应性。AGI已成为人工智能领域许多研究者的终极目标,因为这将使机器能够以与人类相当的准确性和灵活性执行几乎所有任务。

在瑞士,部分开发者认为他们已接近实现人类水平的智能。但一些专家质疑,仅靠大语言模型或类似模型是否足以达成这个目标,以及研发”类人”人工智能是否真是值得追求的目标。

对机器智能的测试

这场竞赛的核心是一家瑞士初创公司Giotto.ai,目前,该公司在全球性的ARC奖(ARC Prize)评比中处于领先地位——这是一项通过一系列视觉谜题来衡量人工智能系统与人类推理能力之间的差距的比赛。截至本文撰写时,Giotto.ai报告称其已解出27.08%的谜题,表现优于Grok 4和GPT-5等热门大语言模型。本轮赛事将于11月3日结束。

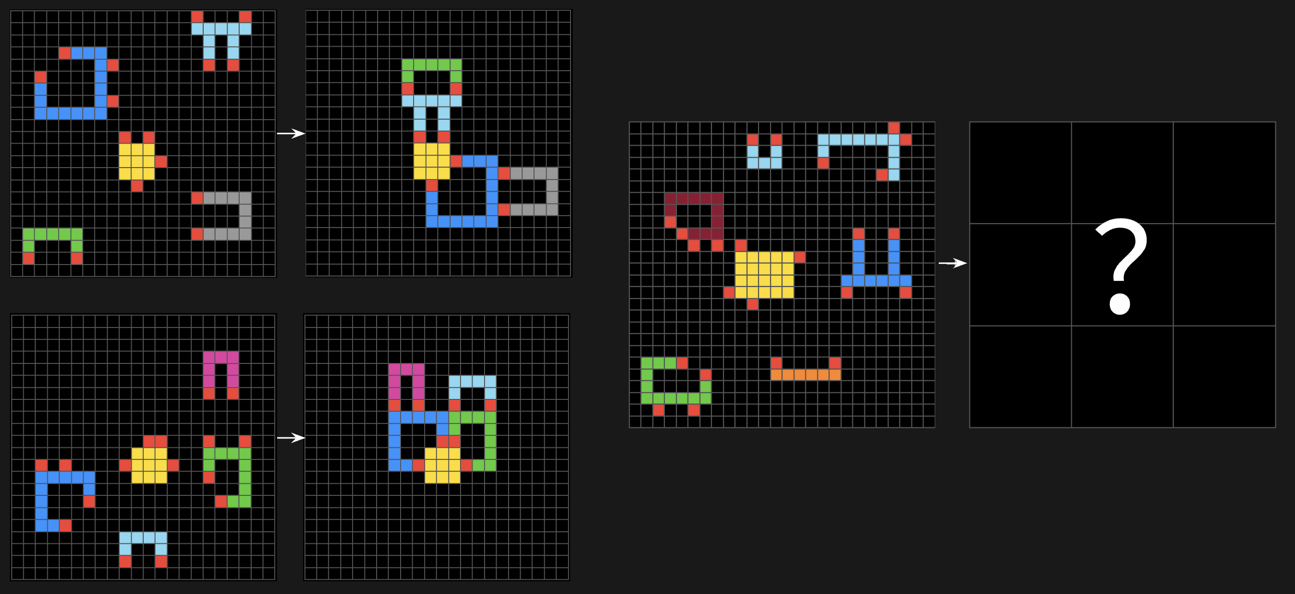

“抽象与推理语料库”(Abstraction and Reasoning Corpus)是全球最重要的衡量通用人工智能进展的测评之一。它通过一系列视觉谜题来测试AI的抽象推理和从实例中进行归纳泛化的能力——这些任务人类通常能轻松解决,但对现有AI系统仍极具挑战。

总部位于达沃斯(Davos)的研究机构Lab42同样致力于通用人工智能的研发。该机构支持全球范围内的程序员,用他们各自的项目尝试解决ARC测试题。2024年,该研究所宣布,他们的一支团队在一次非正式挑战中解出了34%的ARC测试题,创下新的世界纪录。

>> 了解更多关于达沃斯Lab42的信息:

相关内容

一个“中立”的人工智能研发中心正在瑞士阿尔卑斯山区崛起

尽管这一表现令人印象深刻,但仍远低于人类智能水平。ARC测试创建者弗朗索瓦·肖莱(François Chollet)指出,一个”聪明的人类”无需训练即可解答95%以上的试题。

Giotto.ai与Lab42都坚信,赢得这场竞赛将证明他们已接近创造出一种真正类似人类大脑那样运作的技术——具备创造力、实时学习能力、并能迅速掌握新技能。

大语言模型尚未具备足够智能

达莱·莫勒人工智能研究所(IDSIA)科学总监马可·扎法隆(Marco Zaffalon)认为,无论当前AI模型在特定测试中表现多么出色,通用人工智能仍超出其能力范围。

他解释道:”当今大多数大语言模型其实并不具备真正的智能——它们能识别模式,但并不理解因果关系。”扎法隆指出,如果缺乏对因果规律的理解,人工智能将始终局限于基于“相关性”的初级智能层级。

一个真正智能的系统,应该能推演不同情境,并提出”如果……会怎样”的假设。扎法隆补充说,大语言模型看似具备这种能力,但这仅仅源于它们擅长模仿人类文本中的思维模式。

扎法隆认为,实现通用人工智能的障碍在于:当下多数科技巨头更倾向于通过大数据和工程捷径来改进模型,而不是追求一种让AI更像人类大脑的真正科学突破。他强调:”真正的智能需要一种全新的AI研发路径——既能弥补现有模型缺陷,又能开辟新方向。”

推理模型的崛起

一部分研究者认为,新一代被称为“推理系统”(reasoning systems)的人工智能模型,可能有助于克服当前模型的一些局限性。

这类系统同样依赖统计预测技术,但它们通过将复杂问题拆解为更小的部分并依次解决的方式,来模拟人类的思维过程。

苏黎世联邦理工学院计算机科学家托尔斯滕·霍夫勒指出,推理系统能够处理更复杂的问题,尤其是在与大语言模型协同工作时。他的研究团队正积极致力于改进其性能,并将当前成果描述为”已接近人类水平”。

包括Giotto.ai在内的全球企业都寄希望于推理模型能引领他们迈向通用人工智能。Giotto.ai宣称,其系统远比Grok 4或GPT-5等大语言模型更精简更高效,但具体实现机制尚未明确。该公司目前未公开其技术细节,计划在竞赛结束后发布专项报告。

瑞士距通用人工智能更近一步?

若Giotto.ai的人工智能能在ARC竞赛中击败美国科技巨头,对瑞士而言将是非凡成就。但目前尚不清楚这种能解谜的模型如何投入实际应用。”人类能做的远不止解谜,”霍夫勒坦言。

公司首席执行官阿尔多·波德斯塔(Aldo Podestà)在接受瑞士资讯swissinfo.ch采访时表示,若Giotto.ai能在未来一年内实现接近通用智能的目标,任何应用场景都将成为可能。

达莱·莫勒研究所的扎法隆对此类说法依然持高度怀疑态度。他质疑,那些主要基于大语言模型和统计预测的系统,是否能真正达到人类水平的智能。他还指出,来自OpenAI和Anthropic等公司的类似宏大承诺,迄今为止大多被证明只是吸引巨额资本的炒作手段。扎法隆强调,这些企业无一能阐明如何突破因果推理等根本性挑战。

他重申:”依靠现有模型,人类智能仍遥不可及——除非辅以能够理解世界并通过因果关系进行推理的人工智能,而这在今天仍未实现。”

全球顶尖人工智能专家、北京通用人工智能研究院院长朱松纯教授也在邮件中强调,必须开发出全然不同的人工智能技术——一种能够真正理解因果规律、而非依赖预测的系统。

人类级人工智能:诱人却充满风险

人类级人工智能似乎仍遥不可及。但对许多研究者而言,这未尝不是好事。卢塞恩大学(University of Lucerne)伦理学教授、苏黎世联邦理工学院客座教授彼得·G·基施莱格纳(Peter G. Kirschlaeger)指出,在伦理层面,模糊人机界限的人工智能模型存在隐患。

他解释说:”风险不在于机器模仿我们,而在于它们最终可能在无人承担责任的情况下,取代我们做出决定。”

在基施莱格纳看来,人工智能蕴藏巨大潜力,例如推动科学研究发展,或以更可持续的方式解决日常问题。但他坚持认为,维持人与机器之间的界限至关重要,这样才能让每个选择始终扎根于个体的责任。

他总结道:”决策权必须掌握在人类手中:机器应当仅限于执行这些决定。”

(编辑Gabe Bullard,编译自英文:樊桦/gj)

相关内容

符合JTI标准

您可以在这里找到读者与我们记者团队正在讨论交流的话题。

请加入我们!如果您想就本文涉及的话题展开新的讨论,或者想向我们反映您发现的事实错误,请发邮件给我们:chinese@swissinfo.ch。