スイスが挑むAI新時代 「人間のような知能」への挑戦

人間のような思考能力を持つ人工知能(AI)の開発は、世界共通の目標だ。スイスもその競争に加わり、一部の研究グループは大きな成果を上げてきた。汎用人工知能(AGI)や推論システムの研究が盛り上がる一方で、その実現可能性や倫理的妥当性をめぐる新たな課題も浮上している。

ChatGPTが2022年に一般公開されて以来、多くの人がまるで人間と会話するようにAIと接するようになった。しかし現時点で、「人間のような知能」を備えていると証明されたAIツールは存在しない。

現在、一般向けに最も普及しているAIプラットフォームは、大規模言語モデル(LLM)と呼ばれる技術を基盤としている。膨大なテキストデータを学習し、その中の周期的パターンに基づいて次に続く単語を予測する仕組みだ。そのため、人間のようにリアルタイムで学習したり、新たな情報に柔軟に適応したりすることはできない。

連邦工科大学チューリヒ校(ETHZ)のトルステン・へフラー教授(コンピューターサイエンス)は、「LLMは、あたかも人間と同等の知能を持つかのような錯覚を与える。しかし、それはあくまで統計に基づいた模倣にすぎず、本当の意味での理解とは言えない」と指摘する。

世界では今、人間と同レベルの理解力と適応力を持ち、人間と機械の架け橋となるAGIの開発に、さまざまな企業や研究機関がしのぎを削っている。AGIは、人間のような正確さと柔軟性を兼ね備え、理論上あらゆる課題を機械で処理できる可能性を持つことから、AI研究の最終目標とされている。

スイスでも、一部の開発者は、人間の知能に近づきつつあると自信を見せる。しかし、専門家の間では、LLMをはじめとした言語モデルが本当に人間レベルの知能に到達できるのか、そしてそもそも「人間のようなAI」を目指すこと自体が望ましいのか、疑問視する声も少なくない。

AI開発競争で奮戦するスイス企業

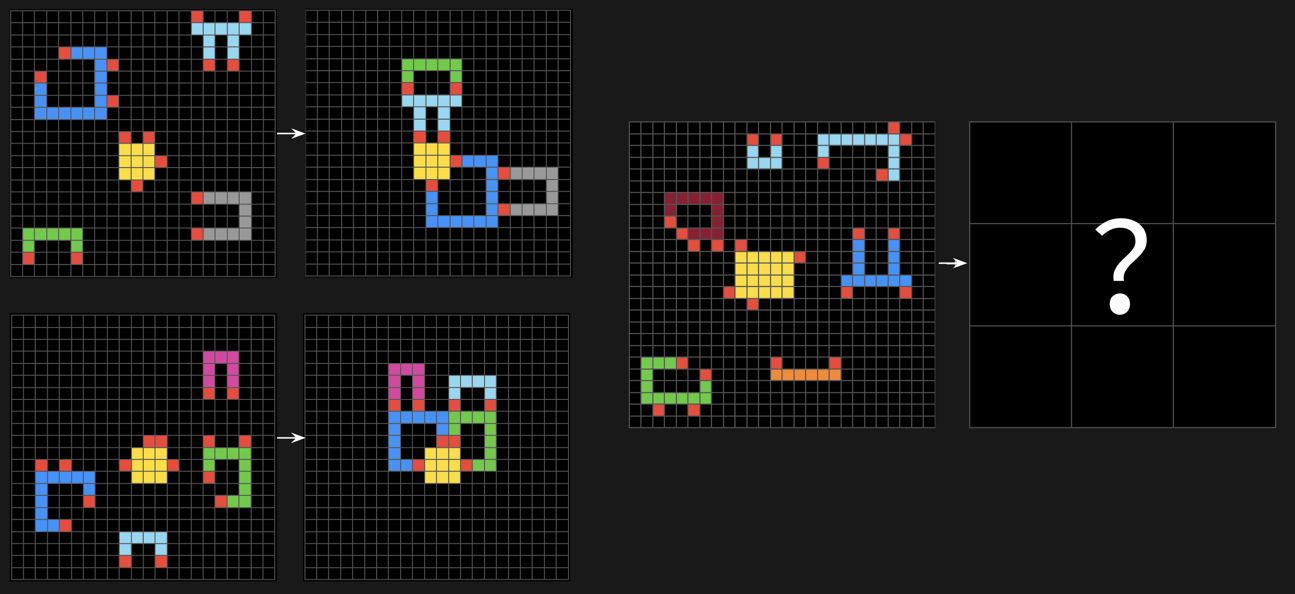

AGIの実現をめぐる国際競争が続く中、注目を集めているのがスイスのAIスタートアップ企業Giotto.aiだ。同社は現在、AIの推論能力を競う国際コンペティションARC Prizeで首位を走っている外部リンク。この大会では、AIシステムが視覚パズル課題をどれほど人間らしい思考力で推論できるかを評価する。本記事の執筆時点で、Giotto.aiは課題の27.08%を解いたと報告しているが、これはGrok 4やGPT-5など世界的に知られるLLMを上回る成績だ。ARC Prize 2025は11月3日に終了予定だ。

Abstraction and Reasoning Corpus(抽象化および推論コーパス、ARC)外部リンクは、AIがどの程度、汎用人工知能(AGI)に近づいているかを測るベンチマークテストで、世界的に知られる。その内容は、AIの抽象的な推論能力や一般化能力をテストする視覚パズルであり、人間であれば比較的容易に解けるが、現行のAIにとっては依然として難しい。

スイス東部のダボスに拠点を置く研究機関Lab42もまた、AGIの実現を目指す組織の1つだ。同機関は、独自のシステムを用いてARCテストの突破を目指す、世界中のプログラマーを支援している。2024年には、非公式ながら所属する開発チームが正答率34%を達成し、世界新記録を樹立外部リンクした。

▼Lab42について詳しくはこちら

おすすめの記事

「中立な」人工知能の国際研究拠点、ダボスで立ち上げ

もっとも、こうした成果もまだ人間の知能には遠く及ばない。ARCテストの考案者であるフランソワ・ショレ氏は、「人間の『賢さ』をもってすれば、特別なトレーニングを受けずとも95%以上の正答率を達成できる」と語る外部リンク。

模倣から真の理解へ

AI研究で世界的に知られるダレ・モッレ人工知能研究所(IDSIA)の科学ディレクター、マルコ・ザファロン氏は、テストの結果に関わらず、現在の AI モデルでは AGI は実現できないと考えている。

「現在のLLMの大半は、真の意味での知能を備えているわけではない。パターンを認識することはできても、その背後にある要因を理解できないからだ」。AIが因果関係を理解できるようにならない限り、それは単にデータを関連付けるだけの基礎的な知能の域を出ることはないという。真に知能を持つシステムは、新しい状況を想像し、「もし~ならどうなるか」と自ら問いかける能力を備えているはずだ。LLMは一見、そのような推論が可能であるかのように見えるが、実際には人間の文章に現れるパターンを巧みに模倣しているにすぎない。

同氏はさらに、AGI開発の問題点として、ビックテック企業によるAI開発の方向性を挙げる。多くの企業が大量のデータを投入し、既存の仕組みで開発を簡略化することにより自社AIの性能向上を図っているが、これではAIを人間の脳に近づけるという真のイノベーションには繋がらない。「真の知能を実現するには、既存のAIモデルの機能を補うような全く新しいアプローチが不可欠だ」

推論システムにかかる期待

一部の研究者の間では、AIの限界を克服する鍵として、推論システムと呼ばれる次世代モデルへの期待が高まっている。

この新たなアプローチは、従来のAIシステムが得意とする統計的な予測に加え、複雑な課題を小さな要素に分解し、順序立てて解決していくことで、人間の思考過程を再現しようとするものだ。

前出のへフラー・ETHZ教授によれば、こうした推論システムをLLMと組み合わせれば、従来よりも複雑な問題に対応できるようになるという。同氏の研究グループはこの分野の研究を積極的に進めており、その成果は「人間に近い」能力を持つとまで評価されている。

世界中の企業が、推論システムこそAGI実現の鍵になると期待を寄せている。Giotto.aiもこのシステムを活用しており、Grok 4やGPT-5といったLLMよりもはるかに小規模で効率的だと主張している。しかし、その精度については現時点で明らかにされていない。Giotto.aiはARC Prize 2025の終了後に技術的な詳細を公表する予定だ。

AIをめぐる意見に温度差

もしGiotto.aiのAIがアメリカの名だたるテック企業を抑えてARC Prize 2025を制することになれば、スイスにとっては大きな快挙だ。その一方で、パズルを解く能力がどこまで実用に結び付くのかについては、依然として見通しが立っていない。へフラー氏は「人間はパズルを解く以上のことができる」と指摘する。

Giotto.aiの最高経営責任者(CEO)であるアルド・ポデスタ氏はスイスインフォの取材に対し、もしGiotto.aiが来年中にAGIという目標達成に近づくことができれば、その技術は無限に応用できる、と自信を見せた。

一方、ザファロン氏はこうした主張に懐疑的な姿勢を崩さず、 LLMや統計的予測を主体とするシステムが、人間レベルの知能に到達できるという考えに疑問を投げかける。同氏は、アメリカのAI開発大手OpenAIやAnthropicなどが掲げてきた同様の宣伝文句も、これまでの成果を見る限り、より多額の資金調達を目的とした誇張に近いと指摘する。これらの企業はいずれも、因果推論といった根本的な課題をどのように克服するのかを、十分に説明できていないからだ。

「世界を因果関係で理解し推論できる新たなAI技術が開発され、現行のAIモデルの機能を補えるようにならない限り、人間の知能はこれからも手の届かない存在であり続ける。今日のAI研究は、まだその段階には至っていない」

同様の見解は、北京通用人工智能研究院の院長であり、世界的なAI研究者として知られる朱松純氏も示している。同氏は、予測に頼らずに因果関係を理解できる、根本的に新しいAI技術の開発が不可欠だと強調している外部リンク。

AIの未来と人間の責任

人間レベルのAIは、依然として実現には程遠いようだ。しかし多くの研究者にとって、それは必ずしも悲観すべきことではない。倫理学を専門とするルツェルン大学のペーター・G・キルシュレーガー教授は、人間と機械の境界をあいまいにするAIモデルには倫理的な危険性があると警鐘を鳴らす。

「機械が人間を模倣できること自体は危険ではない。問題は、それが人間の一切の関与なしに判断を下し、人間に取って代わる可能性があるという点だ」

同氏によれば、AIは科学研究の進歩や日常生活の課題解決などに役立つ大きな可能性を秘めている。それでもなお、人間と機械の適切な距離を保ち、あらゆる選択を必ず個人の責任の下で行うようにすることが極めて重要だという。

「最終的な決定は必ず人間の手で下さなければならない。機械に求められるのは、その決定を実行するという役割のみだ」

編集:Gabe Bullard/gw、英語からの翻訳:本田未喜、校正:大野瑠衣子

おすすめの記事

JTI基準に準拠

swissinfo.chの記者との意見交換は、こちらからアクセスしてください。

他のトピックを議論したい、あるいは記事の誤記に関しては、japanese@swissinfo.ch までご連絡ください。