「ディープフェイク」の脅威に対抗 スイスの研究者ら

人工知能(AI)を駆使した偽(フェイク)動画の精度向上が目覚ましい。スイスの専門家らはこうした技術の悪用がはらむ社会的リスクを踏まえつつ、被害を防ぐための新技術の開発に取り組んでいる。

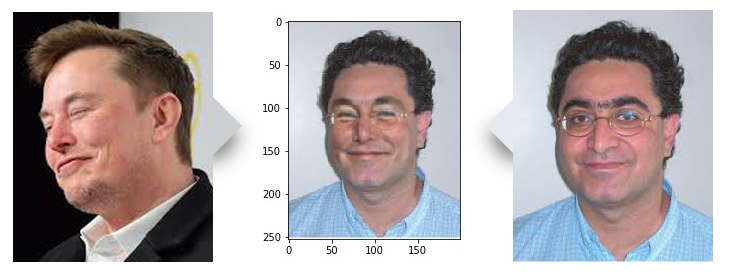

広大なキャンパスを持つ連邦工科大学ローザンヌ校(EPFL)。学内のコンピューター室では、少数の技術者からなるチーム外部リンクがスクリーンを凝視している。映し出されているのは栗色の巻き毛に笑顔のメガネ姿の男性だ。

「よし、上出来だ」と口を開いたのはチームのリーダー、トゥラジ・エブラヒミさん。その風貌は映像の男性にどことなく似ている。それもそのはず、この映像はチームがエブラヒミさんの頭部と電気自動車のテスラ社創業者イーロン・マスク氏の画像を巧みに合成して作ったものなのだ。AIを使って改変したデジタル画像、つまり「ディープフェイク」である。

チームでは、これまでに様々なフェイク画像を制作してきた。本物にそっくりなものもあればそうでないものもあるが、それらは全てサイバーセキュリティー専門のクアンタム・インテグリティー(QI)外部リンク社と共同で行っているフェイク画像検出ソフト開発作業の一部だ。

検出ソフトは「機械学習」により本物と偽物の見分け方を学んでいるが、これはディープフェイクにも使われているプロセスだ。つまり、フェイクを作る側も見破る側も、同じ技術に基づいている。

エブラヒミさんは「大量の学習データを読み込ませることで、機械も人間と同じように偽物を見分けられるようになる」と説明する。「使えば使うほど性能が向上するのだ」

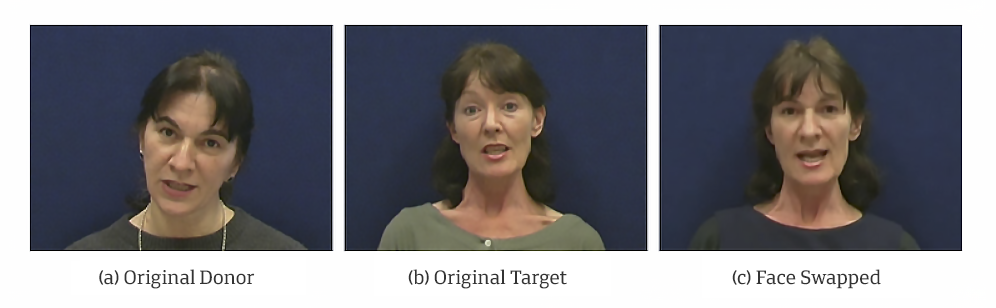

写真やビデオの捏造はマルチメディア黎明期にも既に存在した。しかし、最近ではAI技術の発達により動画の顔だけを入れ替えたり、人が実際には言っていないことを言ったように見せかけたりということが可能になっている。ここ数年のディープフェイク技術の普及は専門家の予想を凌駕した。

EPFLの国際リスクガバナンスセンター(IRGC)外部リンクによると、ディープフェイクビデオの制作は「ユーザーフレンドリーなツールや有料オンラインサービスが普及したことからますますスピーディーで手軽、そして安上がりになった」。

同センターのエンガス・コリンズ副所長は「ディープフェイクの進化スピードが速いだけに、次のターゲットとなりうる分野やグループ、国などを見極めておく必要がある」と述べる。

ディープフェイクは多くの場合ポルノ動画に悪用されてトラブルを起こしているが、世論操作に使われることについても警戒を強める必要がある。

著しい発展

エブラヒミさんがQI社と共同でフェイク検出ソフト開発を始めた3年前は、まだディープフェイクに注目する研究者は少なかった。当時、QI社のクライアントにとっての懸念事項は、自動車保険や火災保険の請求に加工された写真が使われることだった。しかし2019年までにディープフェイク技術の質が急速に向上するにつれ、プロジェクトの焦点もディープフェイクへとシフトしていった。

「ここまで(技術の進化が)急速だとは思わなかった。驚いている」と話すのはQI社のアンソニー・サハキアンCEOだ。

保護フィルムが完全な状態のままパスポートの顔写真をすり替えるなど、ディープフェイク技術の驚くべき進化ぶりは彼自身も目の当たりにしている。

彼ら専門家が不安視しているのは操作技術の進歩だけではない。オンラインにあるディープフェイク動画の総数自体も、オランダのサイバーセキュリティー企業ディープトレース社外部リンクの概算によれば19年9月までの9カ月間にほぼ倍増し、1万4678件に達している。

リスクはどこに

顔をポルノ映像や画像にはめ込むといった悪質なディープフェイクは主に女性をターゲットとしている。ディープトレース社の調べでは、昨年ネットに出回ったディープフェイクの96%がこうしたタイプのものだった。これらの動画はディープフェイクに特化したポルノサイトにアップロードされたり、いわゆる「リベンジポルノ」として被害者の名誉を傷つけることを目的に拡散されたりする。

「ネットハラスメントやネットいじめは定期的に発生している」(コリンズ副所長)。一方、詐欺目的でディープフェイクが使われることはまれで、そのほとんどが声を操作し被害者を騙して送金させるというものだ。

それでも企業は現状把握に怠りない。IRGCが先頃開催したディープフェイクのリスクに関するワークショップには、チューリッヒ保険やスイス・リー、BNPパリバ銀行といった企業が担当者を派遣した。サハキアンQI社CEOによると、保険会社は事故の保険金請求にディープフェイク動画が使用される可能性を懸念している。

「最新技術はKYC(Know Your Customerの略)を時代遅れにしてしまった」と同氏。KYCとは顧客の身元と取引の意図を確認するために用いられるプロセスで、犯罪につながるリスクの排除を目的としている。

その他にも、ディープフェイクが政治利用される可能性についての不安もある。

不安を裏付けるかのように、ナンシー・ペロシ米下院議長がスピーチ中ろれつが回っていないかのように操作した動画が拡散されるという出来事があった。これは「シャローフェイク」と呼ばれるローテク(初歩的技術)を用いて作られたものだったが、エブラヒミさんが指摘するように「どういったことが可能なのか、媒体操作の背後にある意図は何なのかがうかがえる象徴的事件」だった。

だが、リスクを扱う専門家であるコリンズ副所長は、政治におけるフェイク媒体の使用は文脈中で判断されるべきだと警告する。

「ディープフェイクが選挙戦のかく乱に利用されることは考えられる。だが、そのリスクを過大評価するのはどうか。木を見て森を見ずになるのでは」

ディープフェイクが示すものは「デジタルインフォメーションのエコシステム(生態系)が進化するスピードと、それを受け入れる社会との間に生まれつつあるギャップ」だと言う。

ディープフェイクはディスインフォメーション(信用失墜を狙い故意に流す虚偽の情報)作戦のツールとしても使われ、事実と信頼の結びつきにより深い亀裂を生んでいる。

フェイクを作るAIと見破るAI

一部でパニックを引き起こしかねないディープフェイクだが、見た人全員が騙されてしまうほどのクオリティではないという声もある。現状では作者のスキルが大きくものを言うというのが専門家の見方だ。生体認証セキュリティーシステムの専門家、セバスティアン・マルセルさんによると、顔を入れ替えることで必然的に画像の他の部分に狂いが生じる。

「画像の質を上げるためのマニュアル加工次第でクオリティは大きく変わる」とマルセルさん。「細部まで作り込まれた場合は検出が難しくなるかもしれない」

マルセルさんはスイス南西部の町マルティニのイディアップリサーチ研究所外部リンクで、同僚らと共にフェイク検出ソフトの独自開発を行っている。このプロジェクトは元々ビデオ映像における顔と声の操作の検出を目的にスタートしたもので、同研究所では長期的に取り組むとしている。

「この課題は今日明日に解決するものではない」とマルセルさん。「研究の対象としては現在進行形のもの。今後さらにリソースを投入するつもりだ」

一方で、検出がもたらす効果については議論の余地がある。「妙薬は無い。どんな検出技術を打ち出しても相手は抜け道を見つけ出すだろう」(コリンズ副所長)

エブラヒミさんとマルセルさんが異口同音に指摘したのは、プロジェクトの目的は絶対確実なツールを開発することではない、という点だ。検出ソフトの使命の一つは、フェイクが向かう傾向をタイムリーに把握してそれに沿った対策を打ち出すことにある。

イディアップ研究所のマルセルさんは、今後、操作は顔など一部分だけでなく映像全体に及ぶと予測している。

「ディープフェイクはますます精巧になる。それに応じて検出ソフトも改良しなければならない。費用対効果の見地からフェイク動画が無益になることが目標だ」

主要ソーシャルメディアのディープフェイク対策

ツイッターは今月、合成されたり操作されたりして被害を起こす恐れのあるコンテンツについて、拡散を阻止するためユーザー向けに注意書きを付けるなどの新ルールを導入した。

グーグル傘下のユーチューブは、米大統領選と国勢調査を年内に控えて世論のミスリードを狙ったディープフェイク動画を削除することを発表した。フェイスブックは、研究者らを支援するために1000万ドル超をかけて「ディープフェイク検出チャレンジ」を立ち上げた。フェイスブックとグーグルは検出技術開発を後押しするためのディープフェイク動画集を作り研究者に提供している。

(英語からの翻訳・フュレマン直美)

JTI基準に準拠

swissinfo.chの記者との意見交換は、こちらからアクセスしてください。

他のトピックを議論したい、あるいは記事の誤記に関しては、japanese@swissinfo.ch までご連絡ください。