Modelo de IA da Suíça é elogiado por especialista em cibersegurança

Para Bruce Schneier, referência global em cibersegurança, a inteligência artificial criada na Suíça sem fins lucrativos é um exemplo de como a tecnologia pode fortalecer a democracia. Mas só se for usada com responsabilidade.

“Há alguém aqui da Suíça?”, gritou Bruce Schneier ao público. Mas, no Fórum Mundial para a DemocraciaLink externo, em Estrasburgo, não houve oportunidade para responder.

Em sua palestra, em novembro de 2025 sobre IA e democracia, Schneier, que é docente da Harvard Kennedy School, se referiu repetidamente à Suíça: à ideia de uma democracia assistida, que surgiu na Escola Politécnica Federal de Zurique (ETH), mas sobretudo ao Apertus, o modelo de linguagem desenvolvido pela ETH. “Sem interesse de lucro e sem dados roubados”, o modelo de IA da Suíça mostra que uma IA para o bem comum é possível.

“Acho que temos muitos problemas com a democracia. Não são problemas que a IA causou. Muitas vezes são problemas que a IA agravou”, afirma ele em uma chamada através do (aplicativo) Signal em janeiro de 2026. “A questão é: existem maneiras de usá-la para mais democracia? Acho que a resposta é sim. Mas também precisamos fazê-lo.”

Boa previsão para o Apertus

Na revista TimeLink externo, Schneier fez recentemente uma comparação com a ferrovia no século 19: naquela época, as novas rotas ferroviárias nos EUA teriam tido o potencial de “conectar os separados” e tornar o acesso ao poder mais igualitário – em vez disso, tornaram alguns poucos incrivelmente ricos. “Ferrovias são como a IA hoje: infraestrutura pública. Todos nós as usamos para coisas diferentes. Por isso o Apertus é tão poderoso: é uma plataforma sobre a qual todos podem construir”, explica.

Seria um exemplo de que a tecnologia pode existir sem corporações. “Podemos ter modelos de IA que não foram construídos por um bando de bilionários da tecnologia, brancos e homens, com interesse de lucro?”, pergunta Schneier de forma retórica. Um pequeno país mostrou como isso é viável. “Os custos estão caindo e veremos mais desses modelos”, acrescenta. Os modelos de linguagem individuais se tornariam então “em grande parte intercambiáveis” e, por isso, ele acredita que muitos usarão modelos abertos como o Apertus ou o Sea LionLink externo, de Singapura.

Você sabia que a Suíça também tem uma IA? Leia o artigo abaixo para descobrí-la.

Mostrar mais

Verdadeiro ou falso? Fatos e mitos sobre o Apertus, o modelo suíço de IA

Se os serviços de IA serão usados por instituições ou surgirão de iniciativas cidadãs não é decisivo para sua importância para a democracia. Máquinas de escrever são usadas dentro de instituições da mesma forma que fora delas. “A ferramenta de escrita Grammarly é usada para editar coisas na democracia”, diz o especialista.

À questão sobre saber se a falta de confiança na IA não poderia afetar negativamente a democracia, ele responde: “Todos que você conhece usam IA para obter instruções de rota passo a passo no celular”, diz ele. Não se pensa sobre uma confiança real. “A confiança real permanece em segundo plano”, afirma Schneier.

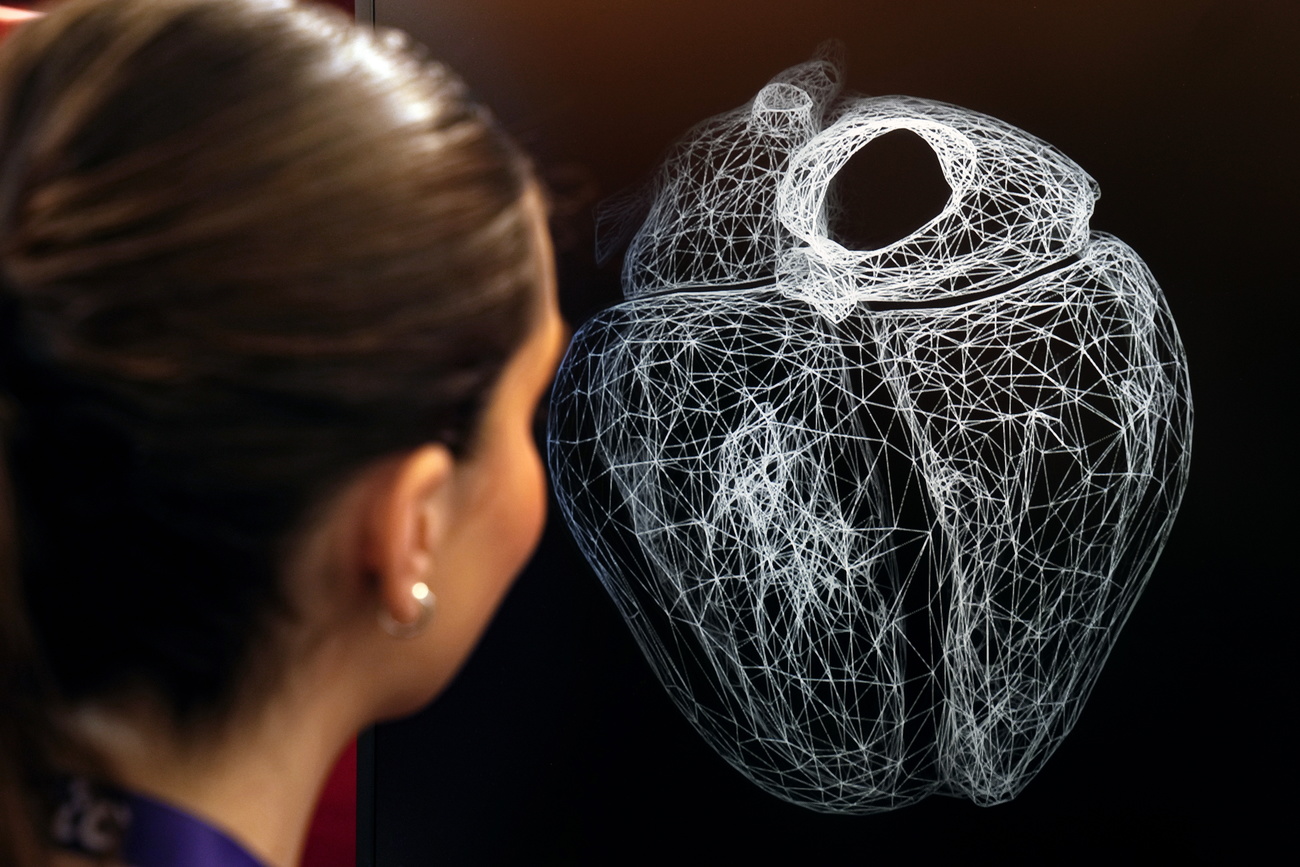

Pessimismo no presente

É preciso observar em qual IA se confia. “A confiança pública em IA com certos modelos de negócios pode ser baixa. Eu não confiaria no Facebook para nada. Mas você confia na IA que analisa suas radiografias. Médicas e médicos a utilizam porque ela faz isso melhor.” Isso é a própria definição de confiança. “Se a IA causa danos, culpem as corporações! Não culpem a tecnologia!” A causa estaria fundamentada em decisões empresariais.

Em Estrasburgo, Schneier soou entusiasmado. Seu artigoLink externo sobre o futuro na revista Time também têm esse tom. Quando falouLink externo diante do comitê de supervisão no Congresso dos EUA, em maio de 2025, seu discurso soou diferente: “Os quatro palestrantes anteriores trataram das promessas dessa tecnologia. Eu gostaria de falar sobre as consequências para a segurança nacional, sobre como nosso país conecta dados e os alimenta em modelos de IA.”

Schneier explicou como colaboradores do DOGE do governo Trump sugam bancos de dados e “os oferecem a empresas privadas como a Palantir”. “Essas ações causam danos irreparáveis à segurança do nosso país e à segurança de todos, inclusive de todas as pessoas nesta sala, independentemente de sua filiação política”, declarou ele ali. Quando Schneier fala sobre a realidade do presente, ele é crítico. Seu otimismo é sobretudo um apelo para o futuro.

Na Suíça, de onde o Apertus é originário, a confiança da população na IA é mista. Segundo o estudoLink externo de 2025, 23% das pessoas na Suíça querem que a IA seja usada na administração apenas em casos excepcionais – e 40% apenas onde exista um claro valor agregado. No estudo “Segurança 25Link externo” da ETH, a IA ocupa a última posição em termos de confiança social. O valor de 4,3 (de 10) caiu ainda 0,3 em relação ao ano anterior.

Cooperar na área de IA

Mas também aqui há otimismo voltado para o futuro. Dirk Helbing, professor de Ciências Sociais Computacionais na Universidade de Zurique, considera: “O caminho iniciado com o Apertus deve ser seguido de forma consequente.” Ele poderia ser ampliado com “motores de busca e plataformas que promovam a democracia para projetos da sociedade civil.”

O Apertus poderia “talvez até se tornar um sucesso de exportação”. Helbing acredita que cooperações internacionais podem valer a pena para o desenvolvimento do Apertus. Ele recomenda, na área de IA em geral, “cooperações com países democráticos comprometidos com os direitos humanos”. Como exemplos, cita Japão, Coreia do Sul, Taiwan e Índia.

Por outro lado, a IA também pode estabilizar regimes baseados em vigilância em massa em ditaduras – com impactos transnacionais.

Ruim para a democracia

O fato de que as democracias do mundo não estejam em boa situação também teria “a ver com o caminho que a digitalização e a IA tomaram recentemente.” “Empresas querem os maiores mercados possíveis, mas muitas pessoas não vivem em democracias. O software desenvolvido para sistemas autocráticos também influencia aquele que é usado aqui”, diz Helbing.

É sabido que modelos de linguagem “podem nos manipular de forma significativamente mais eficaz do que outras pessoas.” Além disso, os mesmos sistemas que “hoje estão em ordem” podem amanhã já se basear em outro algoritmo.

Helbing apresenta muitos motivos para pessimismo, mas ao mesmo tempo se diz “otimista”, porque “no final tem que dar certo, caso contrário teríamos estragado tudo por muito, muito tempo”.

Infelizmente ainda é pouco pesquisado como a digitalização pode contribuir para “liberdade, direitos humanos e democracia”. “Iniciativas da sociedade civil” como “Open Data, Open Source, Open Access, hackathons, maker spaces e ciência cidadã, bem como orçamento participativo” devem ser apoiadas e o “esclarecimento sobre abuso de poder e possibilidades de abuso de tecnologias digitais” deve ser impulsionado.

“Tudo o que permite às pessoas cuidar mais do seu próprio destino deve ser apoiado”, exige Helbing, levando assim um princípio orientador da sociedade liberal para a era da IA. A ciência pode dar uma grande contribuição, mas Helbing considera que a política precisa “finalmente” agir: “Nós, seres humanos, estamos sendo transformados em minas de dados, nossos direitos humanos estão sendo restringidos. É preciso combater isso!”

O que são gêmeos digitais? Nós explicamos no artigo abaixo

Mostrar mais

Como gêmeos digitais podem ajudar a salvar a democracia

IA coleta dados e dissemina vieses

Laetitia Ramelet também vê esse risco. Ela é filósofa política e, na fundação suíça TA-Swiss, dedica-se aos efeitos da tecnologia sobre a sociedade. O uso de IA “para analisar nosso comportamento e nossas preferências” é o que mais lhe preocupa atualmente em relação à democracia.

Recomendações personalizadas e conteúdos em grande quantidade podem ser usados por “profissionais que dominam bem esses métodos para influenciar pessoas de forma sutil”.

Na perspectiva de Ramelet, na concepção de votação e campanhas eleitorais a IA também já atua diretamente sobre a democracia. “Duas coisas já se pode afirmar com segurança, pois foram comprovadas várias vezes: outputs escritos de IA podem ser muito convincentes, e a força de persuasão tem grande efeito em uma democracia”, explica ela.

Os modelos de IA multiplicariam seus vieses, distorções e tendência à uniformização, pelo menos quando não há medidas preventivas. Ramelet, que dedica seus estudos profundamente aos deepfakes, vê naturalmente também os muitos conteúdos falsos e enganosos gerados rapidamente como um risco para a informação e a orientação em uma democracia.

Além das interações, Ramelet conta com serviços de IA como parte das instituições democráticas. Há “muitos projetos em andamento” e “iniciativas nesse sentido”. Pelo menos no setor público suíço, ela observa que direitos fundamentais, proteção de dados e controle estão sendo “levados a sério” nesse processo.

O atual governo dos EUA não se preocupa com essas coisas. “Sim, o governo continuará a usar IA para desmontar a democracia – porque esse é o seu objetivo”, diz Bruce Schneier. “E as pessoas que se opõem a ele usarão IA para a democracia.” A IA não altera o equilíbrio. Ela dá mais poder a ambos os lados.

Participe do debate abaixo

Mostrar mais

Edição: Marc Leutenegger

Adaptação: Flávia C. Nepomuceno dos Santos

Certificação JTI para a SWI swissinfo.ch

Mostrar mais: Certificação JTI para a SWI swissinfo.ch

Veja aqui uma visão geral dos debates em curso com os nossos jornalistas. Junte-se a nós!

Se quiser iniciar uma conversa sobre um tema abordado neste artigo ou se quiser comunicar erros factuais, envie-nos um e-mail para portuguese@swissinfo.ch.