¿Es la IA suiza un motor para la democracia?

El experto estadounidense en ciberseguridad Bruce Schneier tiene puestas grandes esperanzas en un modelo suizo de inteligencia artificial (IA). Otras personas especialistas en la materia, por su parte, se muestran optimistas ante la posibilidad de que la IA llegue a ser parte fundamental de las instituciones democráticas.

En una conferencia celebrada el pasado mes de noviembre en el Foro Mundial para la DemocraciaEnlace externo en Estrasburgo, el experto estadounidense en ciberseguridad Bruce Schneier preguntó: «¿Hay aquí alguien de Suiza?». Nadie respondió.

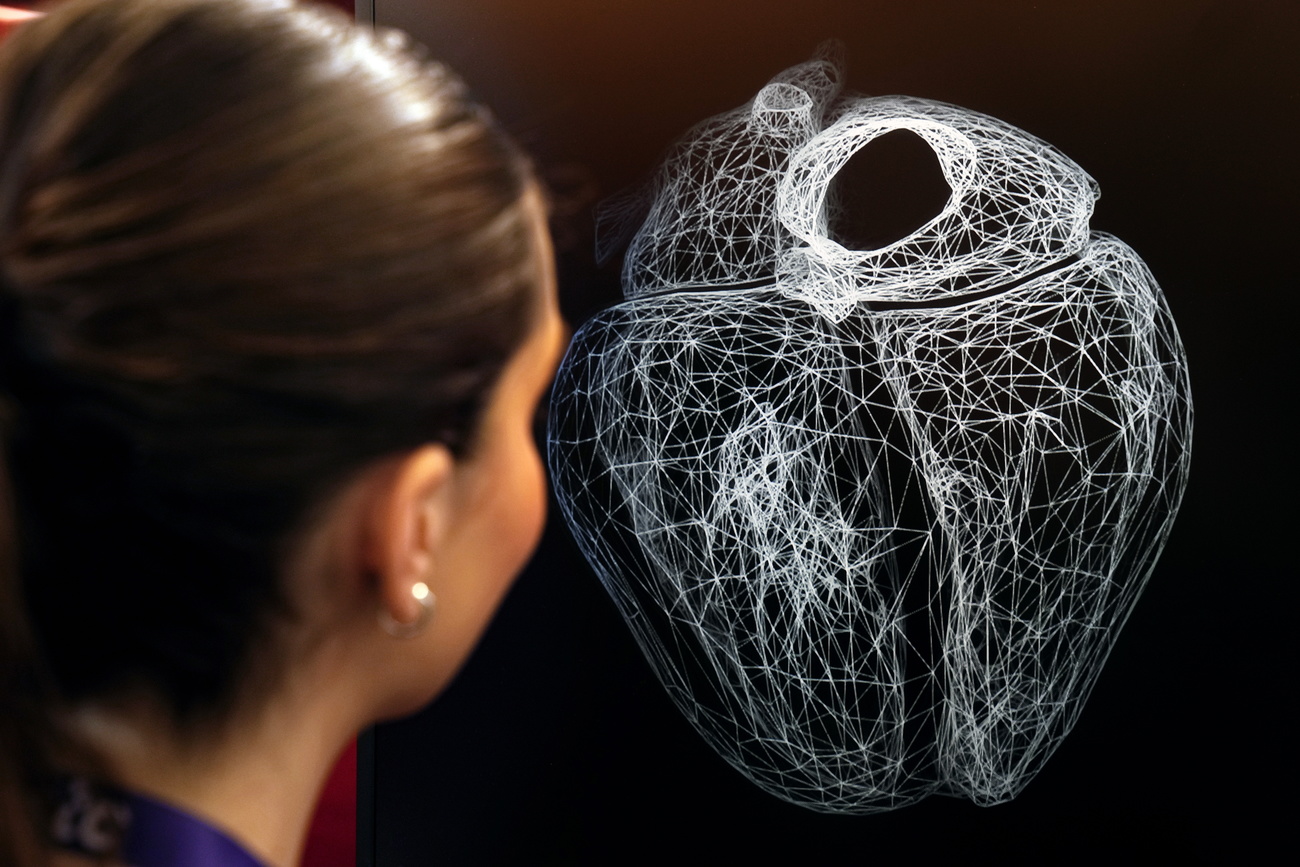

Durante su charla sobre IA y democracia, el profesor de la Escuela de Gobierno John F. Kennedy de la Universidad de Harvard hizo repetidas referencias a Suiza y al concepto de democracia asistida, cuyo origen está en el Instituto Federal de tecnología ETH de Zúrich. Elogió sobre todo el modelo lingüístico Apertus, desarrollado por la Escuela Politécnica Federal de Lausana (EPFL) y por el Instituto Tecnológico Federal de Zúrich (ETH).

Según Schneier, el modelo suizo de IA demuestra que la inteligencia artificial puede beneficiar al bienestar público «sin intereses económicos ni robo de datos».

«Creo que tenemos muchos problemas con la democracia. No son problemas que causa la IA. A menudo son problemas que la IA agrava. La pregunta es: ¿hay formas de utilizarla para fomentar la democracia? Creo que la respuesta es sí, pero tenemos que hacerlo», afirmó Schneier, en enero, durante una llamada a través de la aplicación Signal.

Schneier —en un artículo publicado en la revista TimeEnlace externo— compara la IA con los ferrocarriles del siglo XIX. En aquella época, en Estados Unidos, las nuevas rutas ferroviarias tenían el potencial de «conectar lo desconectado» y equilibrar el acceso al poder. Sin embargo, crearon una riqueza sin precedentes para unas pocas personas.

«Los ferrocarriles son como la IA hoy en día: todo el mundo la utiliza para otras cosas. Esta es la razón por la que Apertus es tan potente», explicó Schneier. «Es una plataforma sobre la que cualquiera puede construir». Este es un ejemplo claro de que la tecnología puede existir sin las grandes corporaciones. «¿Podemos conseguir modelos de IA que no los hayan creado un grupo de hombres blancos multimillonarios tecnológicos y Silicon Valley con ánimo de lucro?», se preguntó Schneier.

Un pequeño país ha demostrado cómo puede hacerse. «Los costes están bajando y veremos más modelos de este tipo», afirmó y añadió que los modelos de lenguaje individuales se volverán «en gran medida intercambiables». El experto cree que muchas personas recurrirán a modelos abiertos como Apertus o Sea LionEnlace externo, desarrollado en Singapur.

>> Lea nuestro artículo en el que explicamos la realidad y los mitos que rodean a Apertus:

Mostrar más

¿Verdadero o falso? Hechos y mentiras sobre el modelo suizo de inteligencia artificial Apertus

El hecho de que las instituciones utilicen los servicios de IA o que estos servicios surjan de iniciativas ciudadanas no determina la importancia que tiene para la democracia. Las máquinas de escribir, al fin y al cabo, se utilizan tanto dentro como fuera de las instituciones. «El asistente de escritura Grammarly se utiliza para editar textos en democracia», considera Schneier.

Schneier rechaza la idea de que la falta de confianza en la IA pueda afectar a la democracia negativamente. «Todas las personas que conocemos utilizan la IA para obtener indicaciones, paso a paso, en sus teléfonos móviles», reconoció. Cuando se trata de la IA, la gente realmente no piensa en la confianza. «La confianza real permanece en un segundo plano».

Según él, la pregunta clave es en qué IA confíamos: «La confianza pública en la IA vinculada a determinados modelos de negocio puede ser baja. Yo no confiaría para nada en Facebook. Pero la gente sí confía en la IA que analiza radiografías. Los médicos utilizan la IA porque puede hacer el trabajo mejor». La esencia de la confianza es eso, argumenta. «Si la IA causa daño, ¡culpen a las empresas! ¡No culpen a la tecnología!». La causa fundamental, dijo, radica en la toma de decisiones corporativas.

En Estrasburgo, Schneier se mostró entusiasta, al igual que lo hace en sus artículos sobre el futuro publicados en la revista TimeEnlace externo. Pero su tono fue diferente cuando el año pasado se dirigió a la Comisión de Supervisión y Reforma Gubernamental del Congreso de los Estados UnidosEnlace externo: «Los cuatro ponentes anteriores se han centrado en las promesas de esta tecnología. Yo quiero hablar sobre las implicaciones para la seguridad nacional de la forma en que nuestro país está consolidando los datos y alimentando con ellos los modelos de IA». Schneier explicó cómo quienes trabajan en el denominado Departamento de Eficiencia Gubernamental (DOGE, por sus siglas en inglés) de la Administración Trump vaciaron las bases de datos del Gobierno y las ofrecieron a «empresas privadas como Palantir».

«Estas acciones están causando un daño irreparable a la seguridad de nuestro país y a la seguridad de cualquier persona, incluidas todas las presentes en esta sala, independientemente de su afiliación política», declaró Schneier. Cuando habla de la realidad actual, se muestra muy crítico. Su optimismo es por encima de todo, un llamamiento al futuro.

En Suiza, donde se desarrolló Apertus, la confianza del público en la IA es dispar. Según el Estudio Nacional sobre Administración ElectrónicaEnlace externo de 2025, para el 23 % de las personas en la administración pública la IA solo debería utilizarse en casos excepcionales, mientras que el 40 % apoya que se use solo cuando aporta un valor añadido claro. La IA ocupa el último lugar en lo que a la confianza del público se refiere en un estudio sobre seguridad nacionalEnlace externo realizado por el ETH de Zúrich, publicado también en 2025. En comparación con 2024 ha bajado 0,3 puntos y tiene una puntuación de 4,3 sobre 10.

Aunque, incluso aquí, hay un optimismo con visión de futuro. Dirk Helbing, profesor de Ciencias Sociales Computacionales en la Universidad de Zúrich, cree que «debe seguirse el camino emprendido con Apertus». Se podría ampliar para incluir «motores de búsqueda y plataformas de promoción de la democracia para proyectos de la sociedad civil», dice.

Apertus «podría convertirse incluso en un éxito de exportación», añadió Helbing, quien considera que las asociaciones internacionales podrían ser beneficiosas para el futuro desarrollo del modelo. En términos más generales, recomienda «la cooperación en el sector de la IA con países democráticos comprometidos con los derechos humanos», y cita como ejemplos a Japón, Corea del Sur, Taiwán y la India.

La IA, al mismo tiempo, también podría contribuir a estabilizar las dictaduras basadas en la vigilancia masiva, con repercusiones transnacionales.

El hecho de que en todo el mundo las democracias estén pasando apuros también está relacionado, según Helbing, con «el camino que recientemente han tomado la digitalización y la IA».

«Las empresas tecnológicas quieren los mercados más grandes posibles, pero mucha gente no vive en democracias. El software desarrollado para sistemas autocráticos también afecta al software que se utiliza aquí», indicó.

Es bien sabido que los modelos lingüísticos «pueden manipularnos mucho más eficazmente que las personas», añadió. Además, señaló que los sistemas que «hoy funcionan bien» mañana podrían funcionar con un algoritmo completamente diferente.

Helbing enumera muchas razones para el pesimismo, pero se define «optimista porque, al final, todo debe salir bien, de lo contrario habríamos estado muy equivocados durante mucho mucho tiempo».

«Lamentablemente, hay poca investigación» sobre cómo podría contribuir la digitalización a «la libertad, los derechos humanos y la democracia», dijo Helbing. Deben apoyarse «las iniciativas de la sociedad civil como Open Data, Open Source, Open Access, Hackathons, Maker Spaces, Citizen Science y Participatory Budgeting» y promoverse «la conciencia sobre el abuso de poder y el posible uso indebido de las tecnologías digitales».

«Debe apoyarse cualquier cosa que ayude a las personas a tomar un mayor control de su propio destino», afirmó Helbing, como una forma de llevar un principio rector de la sociedad liberal a la era de la IA. La ciencia puede contribuir de manera significativa, pero Helbing está convencido de que «ya es hora» de que la política actúe. «Nos están convirtiendo en minas de datos y nuestros derechos humanos están siendo restringidos. Tenemos que hacer algo al respecto».

>> Lea nuestro artículo en el que explicamos la idea de una democracia asistida, que también menciona Bruce Schneier:

Mostrar más

Ciudadanía digital para una democracia innovadora en Suiza y más allá

También es consciente de este riesgo la filósofa política Laetitia Ramelet, que en la Fundación para la Evaluación Tecnológica (TA-Swiss) estudia el impacto social de la tecnología. Ramelet manifiesta que la mayor amenaza hoy en día para la democracia es el uso de la IA para «analizar nuestro comportamiento y nuestras preferencias».

Dice que la gente experta en estos métodos podría utilizar recomendaciones personalizadas y grandes volúmenes de contenido para «influir sutilmente en las personas».

Ramelet también opina que la IA ya está influyendo directamente en el diseño de las campañas electorales y de votación. «Hay dos cosas que son ciertas porque están bien documentadas. Los resultados escritos de la IA pueden ser muy persuasivos, y la persuasión tiene mucho peso en una democracia», afirma.

Según apunta, si no se adoptan medidas preventivas, los modelos de IA pueden amplificar sus sesgos, distorsiones y tendencias hacia la uniformidad. Ramelet, que únicamente estudia deepfakes o ultrafalsos [imágenes, vídeos o audios generados con inteligencia artificial], también considera que la avalancha de contenidos falsos y engañosos generados rápidamente supone un riesgo para tomar decisiones informadas en una democracia.

Aparte de los riesgos, Ramelet espera que los servicios de IA se conviertan en parte integral de las instituciones democráticas. Señala que hay «muchos proyectos en curso» e «iniciativas en este sentido». Ha observado que en el sector público suizo, en este proceso, se están «tomando en serio» los derechos fundamentales, la protección de datos y el control.

Estas cuestiones no le preocupan al actual Gobierno de Estados Unidos. Schneier dice: «Sí, el Gobierno [estadounidense] seguirá utilizando la IA para desmantelar la democracia, ya que ese es su objetivo. Y quienes se oponen a ello utilizarán la IA para defender la democracia».

La IA no cambia el equilibrio de poder, sino que simplemente da más influencia a ambas partes.

Texto original editado por Marc Leutenegger. Adaptado del inglés por Lupe Calvo. Versión en español revisada por Carla Wolff.

>> ¿Y usted qué piensa al respecto? Participe en el debate:

Mostrar más

En cumplimiento de los estándares JTI

Mostrar más: SWI swissinfo.ch, certificado por la JTI

Puede encontrar todos nuestros debates aquí y participar en las discusiones.

Si quiere iniciar una conversación sobre un tema planteado en este artículo o quiere informar de errores factuales, envíenos un correo electrónico a spanish@swissinfo.ch.