La machine et la morale

Les technologies numériques et connectées ouvrent d’immenses horizons à l’économie et à la société, mais posent aussi des problèmes éthiques – à l’instar de la reconnaissance faciale et des fameux chatbots comme ChatGPT. La Suisse, un des pays les plus avancés dans le domaine de l’intelligence artificielle (IA), est mise au défi.

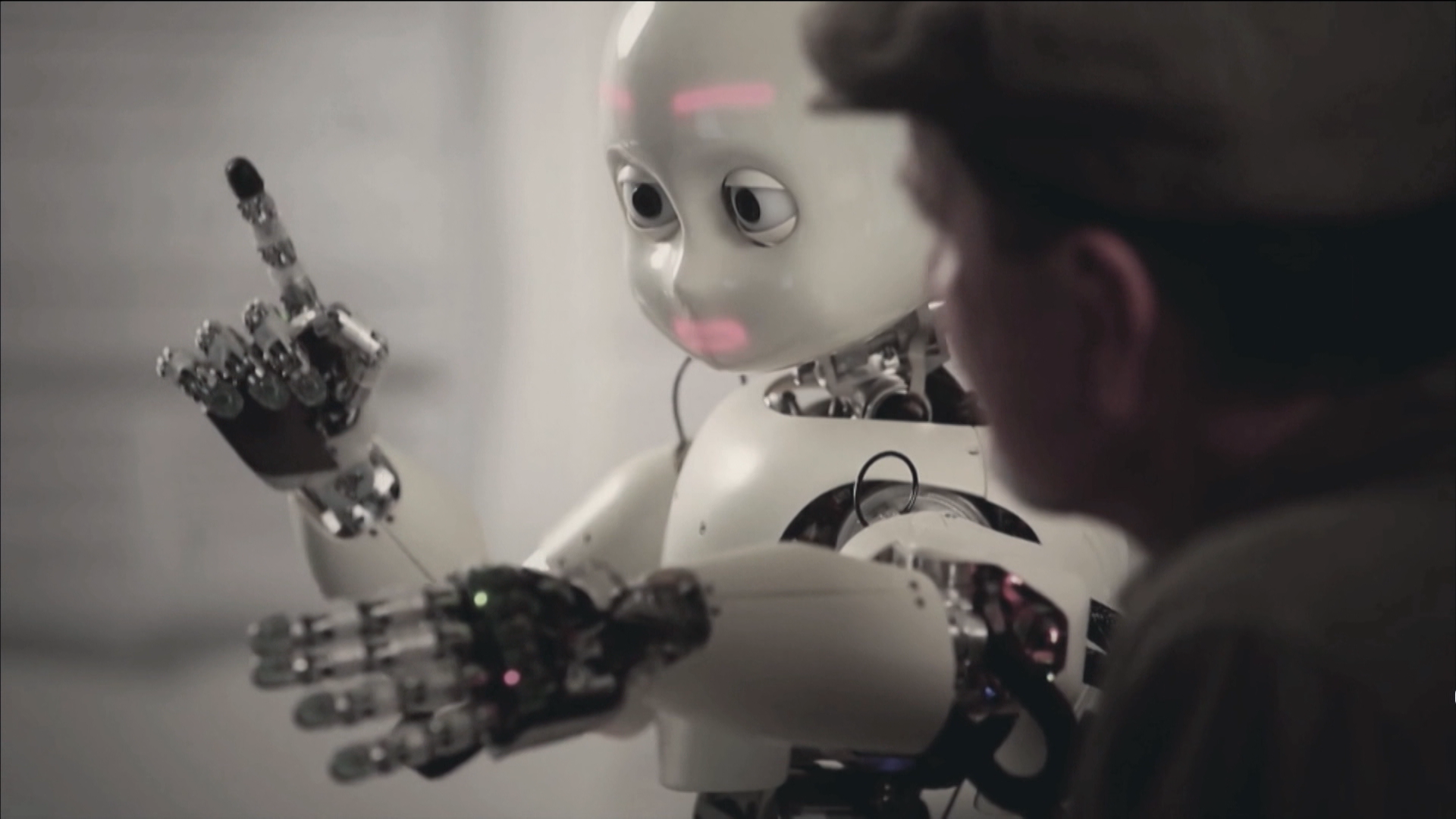

Emplois perdus à cause de l’automatisation, protection des données, reconnaissance faciale, vidéos truquées, et utilisation abusive des technologies de l’IA de de la robotique: la numérisation a apporté un nombre sans précédent de nouveaux défis éthiques.

Exemple le plus récent: le robot conversationnel ChatGPT, basé sur l’IA, qui inquiète différents secteurs. Depuis son lancement à la fin de l’automne 2022, il est sur toutes les lèvres. Et il soulève clairement des questions éthiques.

Plus

ChatGPT: intelligence, stupidité ou malveillance artificielles?

On a peine à simplement imaginer tout ce qui pourrait arriver si l’IA tombait entre de mauvaises mains. Ainsi, les nations du monde n’arrivent pas à s’entendre sur la nécessité de règles strictes pour les robots tueurs. Les discussions menées aux Nations unies à Genève n’ont toujours pas abouti.

Il est vrai que pour l’instant, il n’existe pas encore de telles armes pleinement autonomes. Mais selon celles et ceux qui militent contre, les dépenses massives engagées dans ce domaine et les progrès rapides de l’IA et d’autres technologies-clé laissent prévoir qu’elles pourraient être engagées au combat d’ici quelques années.

Plus

Robots tueurs: interdire ou laisser faire?

La Suisse est un des pays les plus avancés dans le développement de l’IA. Par intelligence artificielle, on entend un logiciel qui apprend à penser et à décider comme un humain. Le processus d’apprentissage est basé sur le traitement de grandes quantités de données.

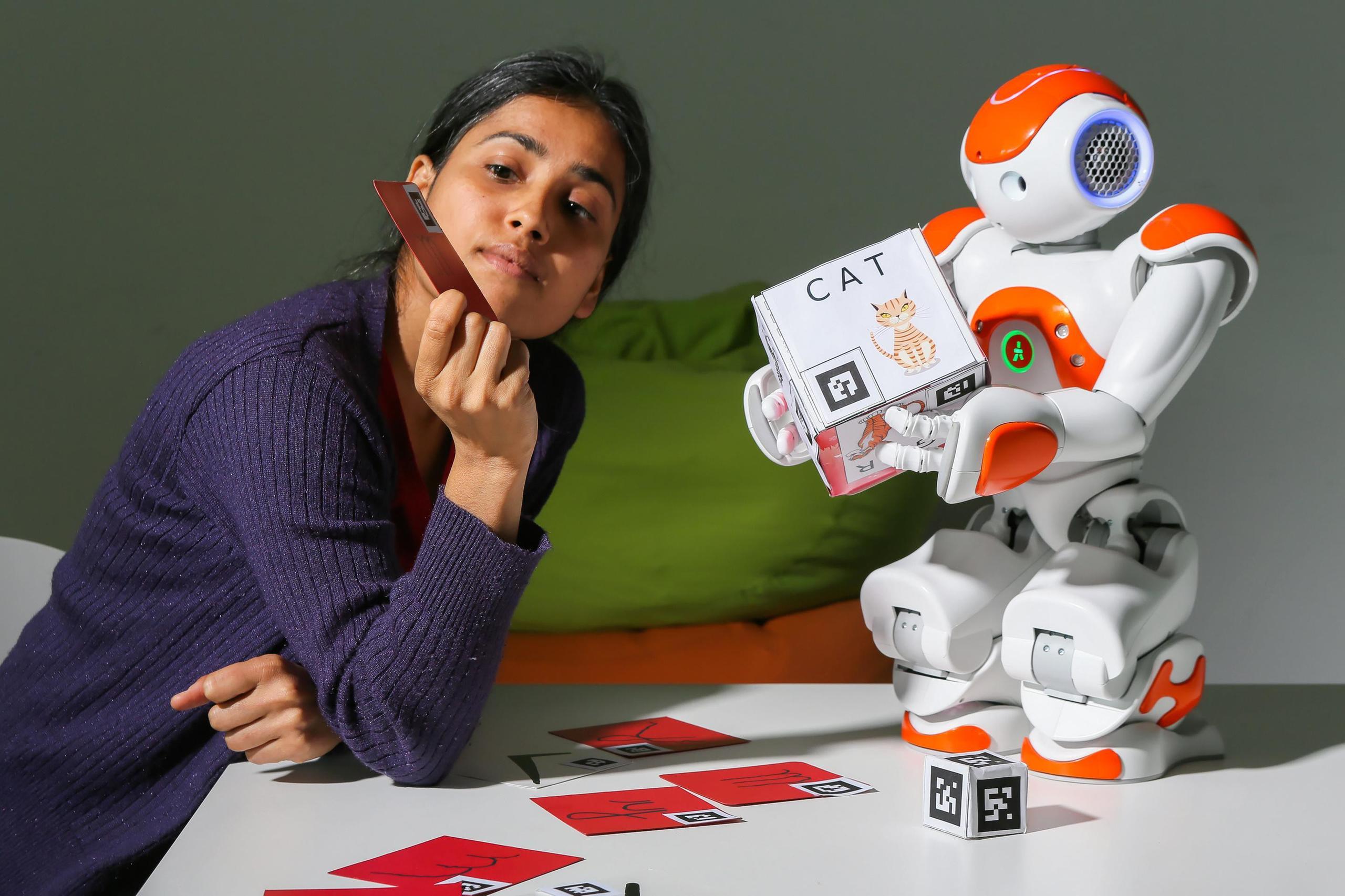

De nombreuses start-ups en Suisse développent de tels systèmes d’apprentissage – sous forme de robots, d’applications ou d’assistants numériques – censés nous faciliter la vie grâce aux mégadonnées (Big Data). Ces entreprises sont constamment confrontées à des questions éthiques. Question sous-jacente: elles veulent avant tout vendre leurs technologies, alors où la ligne rouge se situe-t-elle?

Le problème devient particulièrement évident à l’interface entre recherche et application concrète. Par exemple, les universités suisses participent entre autres à des projets financés par l’armée américaine. Cela va des caméras de surveillance aérienne aux drones de reconnaissance autonomes.

Plus

L’armée US et les universités suisses main dans la main

La Suisse se place

La Suisse entend être pionnière en matière de normes éthiques en rapport avec l’IA. Mais par où la Suisse peut-elle commencer dans sa tentative d’assumer le rôle le chef de file qu’elle souhaite avoir?

Grâce à son statut de pays neutre doté d’un secteur de recherche fort, la Suisse a le potentiel de défier les approches dominantes de la Chine et des États-Unis et de devenir un troisième pôle de recherche en IA. Un pôle qui «n’est pas organisé comme un groupe ou une entreprise d’État», explique Philipp Wilhelm, le maire de Davos.

La ville située des Alpes grisonnes tente de devenir un centre neutre pour le développement de technologies basées sur l’IA qui soient responsables, inclusives et démocratiques.

Plus

Un pôle de recherche en intelligence artificielle «neutre» voit le jour à Davos

Le Swiss Digital Trust Label, qui doit renforcer la confiance des utilisateurs dans les nouvelles technologies, constitue un autre essai. L’idée est de fournir plus d’informations sur les services numériques, de créer la transparence et de garantir le respect des valeurs éthiques.

«Le label doit contribuer à ce qu’un comportement éthique et responsable devienne également un avantage concurrentiel pour les entreprises», explique Niniane Paeffgen, directrice de la Swiss Digital Initiative, à l’origine du Swiss Digital Trust Label.

Plus

Comment renforcer la confiance dans les nouvelles technologies?

Il existe un large consensus sur le fait qu’il faut des règles et des définitions claires sur là où l’on doit placer les limites éthiques. Le Conseil fédéral a créé un groupe de travail «Intelligence Artificielle» et, à fin novembre 2020, il a adopté des lignes directricesLien externe pour l’administration fédérale.

«Il est important que la Suisse exploite les potentiels que recèlent les nouvelles possibilités offertes par l’intelligence artificielle», peut-on lire dans le rapportLien externe du groupe de travail au gouvernement. «Pour ce faire, il convient de créer un cadre optimal lui permettant de s’établir et de s’imposer comme l’un des pays de tête dans le domaine de l’innovation en matière de recherche, de développement et d’application de l’IA. Dans le même temps, nous devons répondre aux risques liés à la mise en œuvre de l’IA et prendre les mesures nécessaires en temps utile».

Plus

La Suisse pourrait-elle devenir un leader de l’intelligence artificielle éthique?

À chacun sa morale

Beaucoup souhaitent une norme mondiale contraignante. Un groupe d’expertes et d’experts de la Commission européenne a présenté à fin 2018 les premières «Lignes directrices en matière d’éthique pour une IA digne de confiance». Et le Parlement européen s’est mis d’accord en juin dernier sur une première version de ce que l’on appelle l’AI Act (loi sur l’IA)Lien externe.

Plus

Où en est la Suisse en matière de réglementation de l’intelligence artificielle?

En décembre 2023, le Parlement européen, la Commission européenne et les États membres se sont finalement mis d’accord sur un cadre réglementaire contraignant pour l’utilisation de l’intelligence artificielle.

En mars 2024, le Parlement européen a donné son feu vert à un durcissement de la réglementation sur l’IA dans l’Union européenne. Il s’agit de la première loi de ce type au monde.

La réglementation vise à interdire les systèmes d’IA qui présentent un risque «inacceptable» pour les citoyens et la démocratie. Il s’agit par exemple de ceux qui utilisent des données personnelles sensibles pour la manipulation psychologique, la classification sociale et le profilage racial, sexuel et religieux.

L’UE a qualifié la décision de moment historiqueLien externe. Mais où en est la Suisse dans ce dossier, elle qui n’est pas membre de l’UE et n’a donc pas pu participer à l’élaboration de cette régulation de l’IA?

Plus

La Suisse a-t-elle raté le train de la régulation de l’intelligence artificielle?

En fait, il existe déjà de nombreux documents et prises de position de ce type un peu partout. Mais aucun ne dit la même chose. Le Health Ethics and Policy Lab de l’École polytechnique fédérale de Zurich (EPFZ) a mené une analyse systématique de tous les textes jugés pertinents: sur 84 documents recensés, il n’a pas trouvé un seul principe éthique commun.

Cependant, on retrouve certaines valeurs fondamentales dans plus de la moitié des déclarations recensées: transparence, justice et équité, prévention des dommages, responsabilité, protection des données et sphère privée.

À l’EPFZ, un nouveau centre de l’IA veut se concentrer au moins sur les valeurs morales européennes. Toute la recherche sur l’IA menée dans l’École doit y être regroupée. Il s’agit de placer l’homme au centre des réflexions comme l’explique dans une interview Alexander Ilic, directeur du nouveau centre.

«La personne qui conçoit quelque chose de nouveau porte également une certaine responsabilité. C’est pourquoi il est important pour nous de contribuer à façonner ce dialogue et de laisser nos valeurs européennes s’exprimer dans le développement des applications de l’IA», dit Alexander Ilic.

Plus

Pour une intelligence artificielle dotée de valeurs européennes

L’argument principal pour l’utilisation de l’intelligence artificielle est probablement qu’elle peut nous simplifier la vie, et nous décharger de tâches fastidieuses, comme peut le faire ChatGPT . Surtout avec des systèmes qui nous aident à gagner du temps. Dans le meilleur des cas, l’IA peut même sauver des vies humaines, par exemple en combinaison avec un drone de sauvetage, capable de travailler dans les endroits les plus difficiles d’accès.

Plus

Des drones suisses à la rescousse!

En outre, l’IA pourrait aussi contribuer à réduire les émissions globales de gaz à effet de serre. Le think tank du Parlement européen estime le potentiel de réduction entre 1,5 et 4% d’ici 2030. Ce qui correspondrait en gros au total des émissions du trafic aérien.

«Transformer les systèmes pose de nombreux défis dans les domaines de l’approvisionnement en énergie, de l’alimentation, du logement et des transports», écrit le groupe de travail IA de la Confédération. Pour lui, l’intelligence artificielle est «une technologie centrale pour répondre à ces défis».

Avec la pandémie de coronavirus, de nombreux services sont passés au numérique presque du jour au lendemain. Cela a donné un véritable coup de fouet à l’IA au quotidien. Par exemple, avec l’engagement de robots pour désinfecter les surfaces dans des bâtiments publics comme les écoles et les hôpitaux.

Plus

Les robots vont nous aider à gérer la Covid-19, mais pas de la manière dont nous l’imaginons

La crainte pour les emplois

De nombreuses personnes n’en sont pas moins critiques envers l’IA. Pour le regretté astrophysicien Stephen Hawking, l’intelligence artificielle était «soit la meilleure, soit la pire chose qui puisse jamais arriver à l’humanité». L’IA et les robots pourraient menacer non seulement les emplois, mais les humains eux-mêmes, craignent ceux qui dénoncent les «robots-tueurs».

Dans la société aussi, le scepticisme monte. L’industrie est déjà en pleine révolution: le Big Data, l’intelligence artificielle, l’internet des objets, les imprimantes 3D modifient les exigences imposées aux travailleurs. Les tâches simples sont de plus en plus confiées à des machines.

Plus

«La révolution numérique agit comme un tsunami sur l’industrie suisse»

On s’attend donc à ce que l’utilisation de l’IA dans les entreprises conduise rapidement à une rationalisation drastique des tâches. Les recherches montrent que plus de la moitié des travaux actuellement effectués par l’homme pourraient l’être plus rapidement et plus efficacement par des systèmes automatisés.

Le chercheur suisse Xavier Oberson propose donc de taxer les robots quand ils accomplissent un travail traditionnellement dévolu à l’homme. Selon lui, les revenus de cet impôt sur les robots devraient être affectés à la sécurité sociale et à la formation des chômeurs.

Plus

Faut-il faire payer aux robots les pertes d’emplois?

Et les consommateurs? Où se situent-ils dans ce vaste débat? Il semble qu’ils se montrent le plus souvent sceptiques à l’égard des applications de l’IA. Selon des étudesLien externe, leur premier souci n’est toutefois pas la capacité de l’IA à contrôler, voire éliminer l’humanité, mais plutôt la sécurité de leurs propres données. Les producteurs sont donc de plus en plus sous pression pour rendre leur technologie transparente pour les utilisateurs.

L’expert Alexander Ilic cite un exemple tiré des objectifs de son centre de l’IA: «Nous voulons montrer, en dialogue avec le public, ce que l’IA peut réellement accomplir. Il existe de nombreux exemples concrets. Notamment ce qui se passe dans le domaine de la médecine et de la santé numérique. Cela concerne tout le monde, est facile à comprendre et apporte de nombreux changements positifs. Mais nous voulons aussi montrer que l’intelligence artificielle soutient les gens, elle ne les remplace pas».

Plus

Daniel Häni: «Pour le zèle et l’obéissance, il y a des machines»

Plus

Le premier Master suisse en intelligence artificielle

(Traduction de l’allemand: Marc-André Miserez)

En conformité avec les normes du JTI

Plus: SWI swissinfo.ch certifiée par la Journalism Trust Initiative