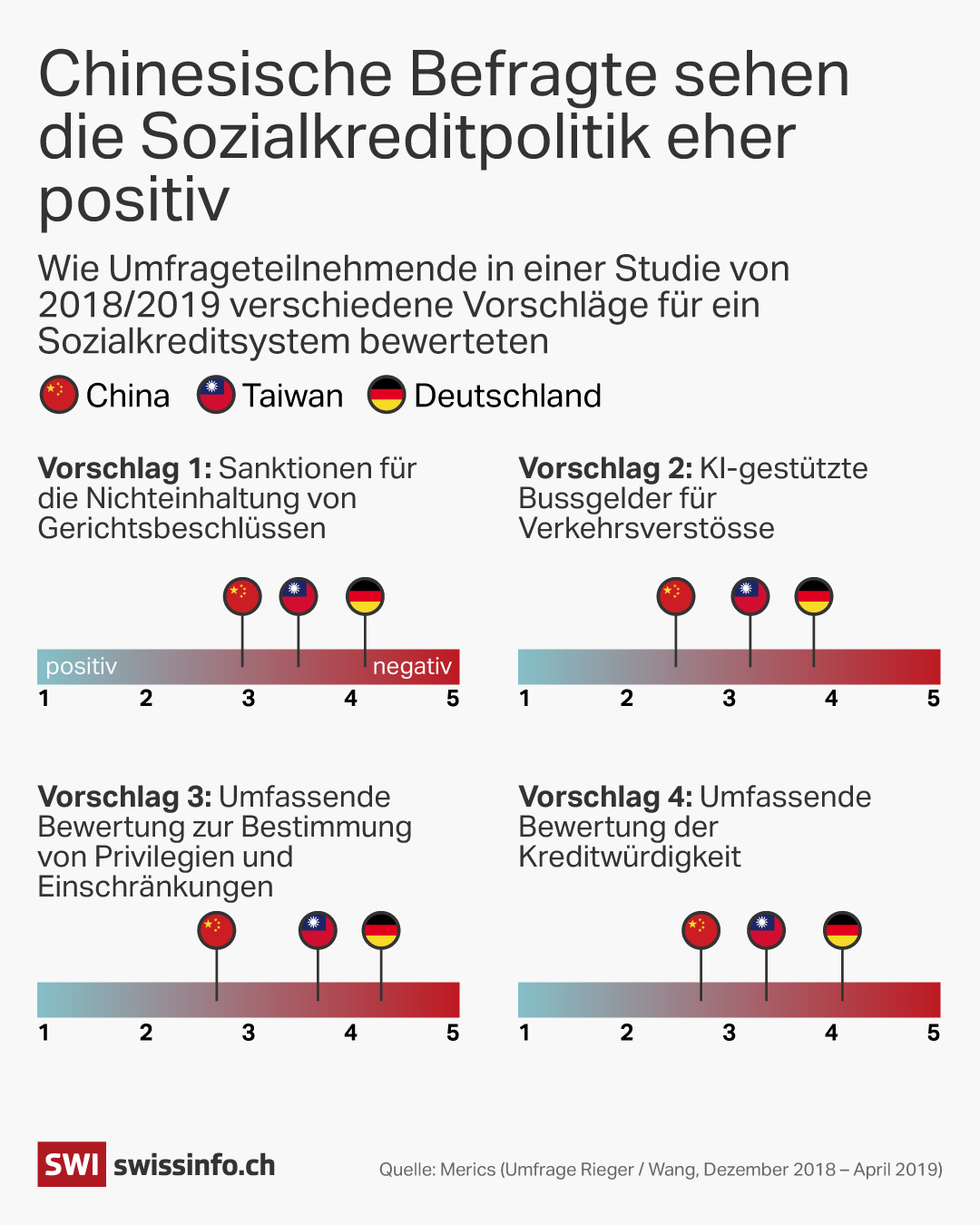

Gefährden Bonus-Systeme wie in China Demokratien wie die Schweiz?

Chinas Sozialkreditsystem hat Ängste vor einer ähnlichen Entwicklung anderswo geweckt. Ein Schweizer Team forscht aktuell dazu, wie Demokratien Social Scoring verhindern können.

Eine Gesellschaft, die belohnt, wenn man ordentlich parkiert und gesund lebt, klingt für einige wünschenswert. Für viele besorgniserregend. Denn selbst ein Bonuspunktesystem, das nur belohnt und nicht bestraft, könnte Menschen mit wenig Punkten an den Rand drängen.

Pilotprojekte in China und dystopische Filme haben viele für diese Thematik sensibilisiert, die viele Namen trägt: Staatskritische Kreise fürchten staatliches Nudging. Andere sprechen von Social Scoring-, Bonus- oder Sozialkreditsystemen.

«China darf nicht unser Masstab dafür sein, was wir in westeuropäischen Gesellschaften wollen», sagt Johan Rochel. Rochel ist Teil eines Teams, das für die Schweizer Stiftung für Technologiefolgen-Abschätzung TA-Swiss zum Thema forscht. Die Ergebnisse werden 2026 präsentiert.

Bonussystem mit direkter Demokratie im Deutschland der Zukunft

Bereits 2020 hat eine Zukunftsstudie im Auftrag des deutschen ForschungsministeriumsExterner Link ein Szenario entworfen, wie sich in den 2030ern in Deutschland ein solches «Bonussystem» etablieren könnte.

Ein Deutschland mit einem Bonussystem könne auch höhere Lebensqualität bedeuten. Dies gelingt dank «datenbasierte[r] Optimierung der Daseinsvorsorge», wie es in der Studie heisst. Das Punktesystem könne der Politik «als Prognose und Steuerungswerkzeug zur Optimierung der Wirtschaft und Implementierung von Zielvorgaben» dienen.

Laut der Zukunftsstudie müsste man Social Scoring jedoch in der repräsentativen Demokratie Deutschlands zusammendenken mit direktdemokratischen Instrumenten. Wie man sie aus der Schweiz kennt.

In dem Szenario würde eine neue «Digital Liquid Democracy» die «Spielregeln» des Systems festlegen.

Die Menschen in Deutschland würden, unterstützt von digitalen Assistenten, immer wieder neu justieren, welches Verhalten belohnt wird: Anstand? Ökologische Lebensweise? Verzicht auf Alkohol? Alle sollten mitentscheiden über das System, das sie reguliert und belohnt.

Lesen Sie hier unseren Artikel darüber, wie digitale KI-Assistenten die direkte Demokratie verändern könnten:

Mehr

Die KI würde den Mainstream wählen, zeigt ein Experiment der ETH Zürich

Die Zukunftsstudie, die dies als eines von sechs Szenarien für 2030 exploriert, zeigt auch Nachteile auf. Das Bonussystem würde wohl zu «neuen Konflikten» führen. Wer einmal weniger Punkte hat als seine Mitmenschen, käme kaum mehr aus dieser Lage und würde zu den «Dauerabgehängten» gehören.

EU-Verbot von Social Scoring-KI

Seit Erscheinen dieser Studie 2020 ist die Wahrscheinlichkeit eines solchen Szenarios eher geschrumpft: Die Europäische Union hat 2024 KI-Algorithmen verboten, die Social Scoring-Zwecke verfolgen. In der Schweiz gibt es jedoch noch keine solche Gesetzgebung.

Der Sinologe Adam Knight Externer Linkvon der Universität Leiden begrüsst das Verbot in der EU. Damit mache man klar, dass Social Scoring mit europäischen Werten inkompatibel ist.

Aus Sicht der EU gefährde Social Scoring Privatsphäre, Gleichheit und ordentliche Verfahren, weil Menschen auf algorithmische Profile reduziert werden. Man müsse sich nicht nur vor Überwachung fürchten, sondern auch von «automatisierter Diskriminierung», erklärt Knight.

Über 50 Gesetze zu Sozialkrediten in China

In ChinaExterner Link hat sich das System inzwischen national etabliert. «In den letzten Jahren hat sich das chinesische Sozialkreditsystem in aller Stille von lokalen Experimenten und sensationslüsternen Pilotprojekten hin zu gesetzlicher Standardisierung und bürokratischer Durchsetzung entwickelt», führt Knight aus.

Gemäss dem Sinologen sei 2022 ein Wendepunkt gewesen: «Seitdem haben sich die Behörden darauf konzentriert, Kreditmechanismen in nationale Vorschriften einzubetten, und mittlerweile enthalten über 50 Gesetze Bestimmungen zu Sozialkrediten.»

Noch immer seien schwarze Listen zentral. Doch neue Reformen hätten Möglichkeiten gebracht, den «Kredit zu reparieren» und setzen auf Belohnung und Rehabilitierung. Pilotprojekte – wie das Erfassen von Alkoholkonsum und Trainings – habe man «still auslaufen lassen». Es gehe weniger, um «moralische Disziplinierung», sondern um die Wirtschaft.

Statt eines einzelnen Scores gebe es in China jetzt eine «Durchsetzungsinfrastruktur». Aus Daten zu Übertretungen entstehe ein «weites Netzwerk von Red Flags», die den Zugang zu Krediten, Verträgen, Jobs oder öffentlichen Dienstleistungen verhindern können.

«Was bleibt ist ein mächtiges, datengetriebenes Instrument, um durch Sichtbarkeit zu regieren: Wenn du die Regeln brichst, hinterlässt es eine Spur», erklärt Knight.

Was ist mit dem Betreibungsregister in der Schweiz?

Doch auch in der EU existiere bereits «algorithmisches Profiling», findet Knight. Entsprechend bringe das EU-Verbot die Frage auf, wie mit diesen umgegangen werden soll. Die «Logik Vertrauen zu belohnen und Risiken zu bestrafen», gebe es «auch in vielen westlichen Systemen».

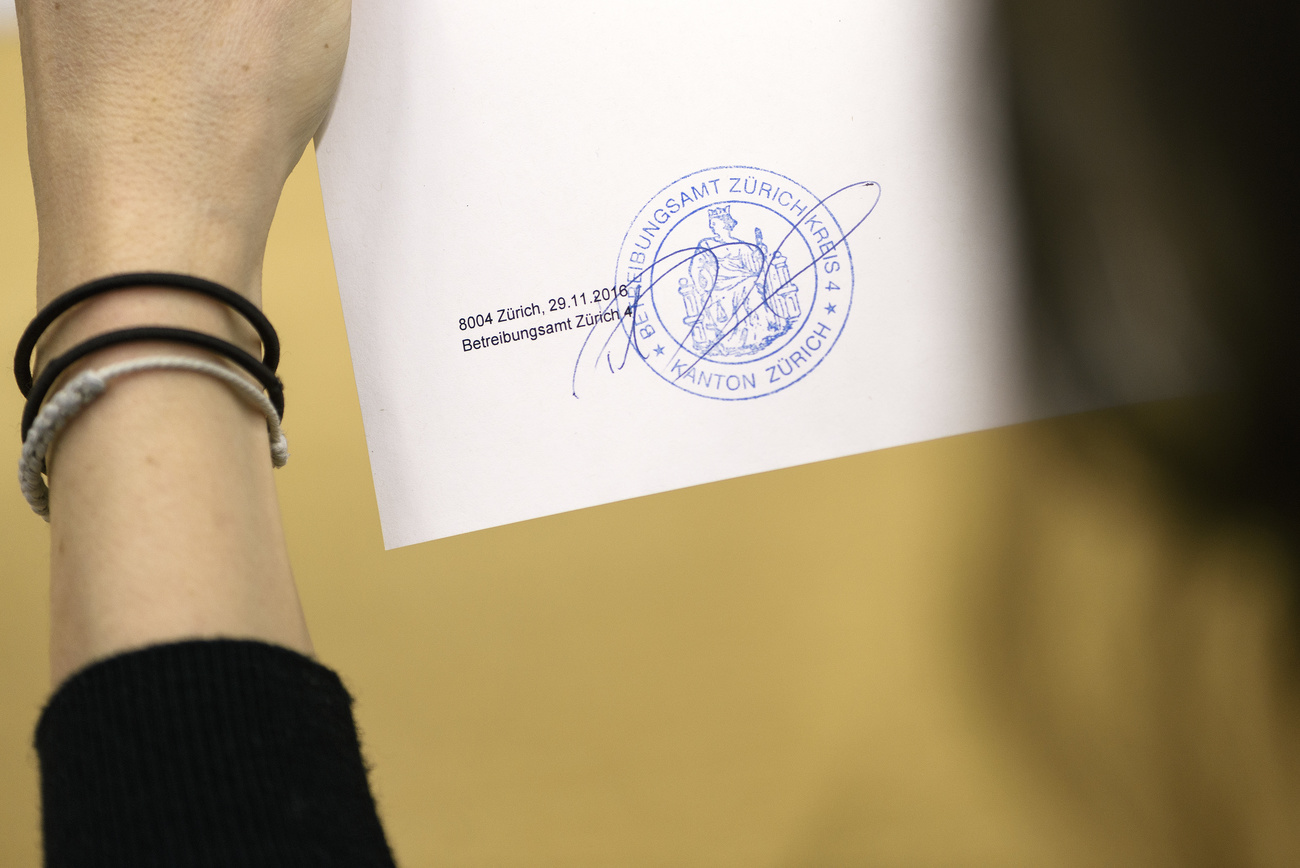

Knight nennt Angebote wie jene von AirBnB, Uber und Yelp, Kreditbüros. Dort sind Bewertungen und Scores folgenreich. Analoge Systeme sieht er aber auch von staatlicher Seite: «In der Schweiz, zum Beispiel, listet das Betreibungsregister öffentlich Individuen, die ihre Bussen oder Rechnungen nicht zahlten.»

Da Einträge im Betreibungsregister verhindern können, dass man eine Wohnung oder «sogar» einen Job erhält, sei dies einer schwarzen Liste im Sozialkreditsystem nicht unähnlich.

Die entscheidende Frage ist für den Sinologen nicht, ob dies dasselbe ist wie in China, sondern, «wie Daten und Verhaltensprofile den Zugang zu Dienstleistungen weltweit mehr beeinflussen und welche Sicherheitsvorkehrungen zum Schutz der individuellen Rechte» bestehen.

Wie erkennt man Social Scoring?

Der Schweizer Wissenschaftler Johan Rochel sagt: «Das Herausfordernde ist, Social Scoring als solches zu erkennen.» Das TA-Swiss-Forschungsprojekt wolle entsprechend gerade da einen Beitrag leisten: Wie soll die Gesellschaft Social Scoring definieren und wie kann sie es erkennen?

«In den EU-Richtlinien zu KI gehört Social Scoring zu den verbotenen Anwendungen», sagt Rochel, «Aber es fehlt noch eine klare Definition davon, was das genau umfasst.» Der Jurist und Philosoph glaubt, kommende Rechtsfälle werden herausschälen, was in der EU unter das Verbot fällt.

Doch Rochel erwartet, dass staatliche Stellen oder Privatunternehmen auch in Zukunft «selbst nicht Bescheid wissen, ob sie ein Social Scoring-System einsetzen oder etwas anderes». Rochel fürchtet mangelnde öffentliche Debatten – und die «Einführung über eine Pilotprojekt-Logik».

Braucht es ein neues Menschenrecht im Digitalen? Lesen Sie hier, wie das Recht auf «digitale Integrität» sich in zwei Kantonen durchgesetzt hat:

Mehr

Digitale Menschenrechte made in Switzerland

Besonders heikel seien alle Bereiche, wo es um das Gemeinwohl gehe. Er nennt das Beispiel einer Software, die vor einigen Jahren Schlagzeilen in der Schweiz machte. Mit dieser konnten Lehrer:innen ihre Schüler:innen als Terrorgefährder:innenExterner Link melden. Mittlerweile ist die Webseite des Angebots offlineExterner Link.

Risikobereiche Transport, Umwelt, Gesundheit

Neben der öffentlichen Sicherheit seien laut Rochel die Bereiche Transport, Umwelt und Gesundheit risikoreich. Der jetzige deutsche Bundeskanzler Friedrich Merz schlug im WahlkampfExterner Link einen Krankenkassenrabatt vor. Alle, die ihre Gesundheitsdaten für die Auswertung zur Verfügung stellen, sollten 10% weniger für die Krankenversicherung zahlen.

Solche Vorschläge klingen, so Rochel, erstmal harmlos – gerade der Freiwilligkeit wegen. Aber anders als bei einer Pflicht oder einem Verbot verwische der freiwillige Charakter, wenn das freiwillige Angebot de facto verpflichtend wird. Zum Beispiel, wenn der soziale oder monetäre Preis fürs Nichtmitmachen zu hoch würde.

Allerdings löste Merz’ Vorschlag Anfang 2025 viel Echo und Kritik aus. Und auch in der Schweiz gab es, zu Rochels Freude, schon eine parlamentarische Debatte zum Thema. Diese Öffentlichkeit nennt er «eine Art Schutzmechanismus» gegen eine schleichende Einführung.

SVP-Nationalrat Thomas Burgherr machte 2020 eine Anfrage dazu, wie sich der Bundesrat zu «Verhaltenstreiber und andere[n] «kleine[n]» Psychotricks der VerhaltensökonomieExterner Link» stelle und wie dies mit Demokratie und Rechtsstaat zusammengehe.

Aus der Antwort des Bundesrats geht hervor, dass die Regierung Nudges als Alternative zu Verboten sieht und «verhaltensökonomische Erkenntnisse und Methoden (…) in einzelnen Bereichen eine Rolle spielen» können.

Die Autor:innen der deutschen Zukunftsstudie von 2020 indes sehen die Effekte von demokratischen Mechanismen heute etwas skeptischer. Studienautor Michael Astor teilt auf Anfrage mit, die Argumente für die Kombination des Bonus-Systems mit direkter Demokratie seien gewesen, das System gegen Missbrauch zu schützen, das Risiko gesellschaftlicher Spaltung abzuschwächen und das Bonussystem an «wandelnde gesellschaftliche Bedarfe» anzupassen.

Astor scheint das Szenario heute kritischer zu sehen als beim Erscheinen der Studie: «Angesichts des Abdriftens vieler Demokratien nach rechts steigt die Skepsis gegenüber völkisch, rassistisch oder wie auch immer motivierter sozialer Kontrolle, die mit entsprechenden Systemen umgesetzt werden kann.» Der von ihnen beabsichtigte «positiv, weil partizipativ gestaltende Effekt» rücke in immer weitere Ferne.

Editiert von David Eugster

Lesen Sie auch unseren Artikel über Menschen, die aus Prinzip kein Smartphone nutzen:

Mehr

Warum manche Menschen kein Smartphone haben wollen

In Übereinstimmung mit den JTI-Standards

Einen Überblick über die laufenden Debatten mit unseren Journalisten finden Sie hier. Machen Sie mit!

Wenn Sie eine Debatte über ein in diesem Artikel angesprochenes Thema beginnen oder sachliche Fehler melden möchten, senden Sie uns bitte eine E-Mail an german@swissinfo.ch